Õ£©õ║Üķ®¼ķĆŖõ║æń¦æµŖĆõĖŖµ×äÕ╗║µÖ║ĶāĮµ╣¢õ╗ō’╝łõĖŖ’╝ē

µ¼Ī

µ¼Ī

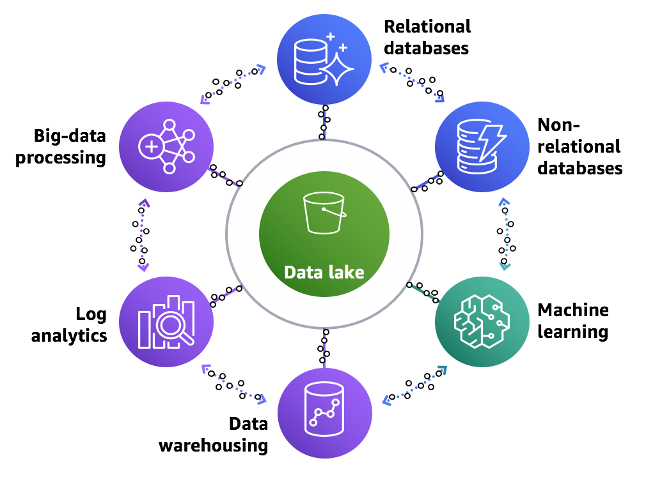

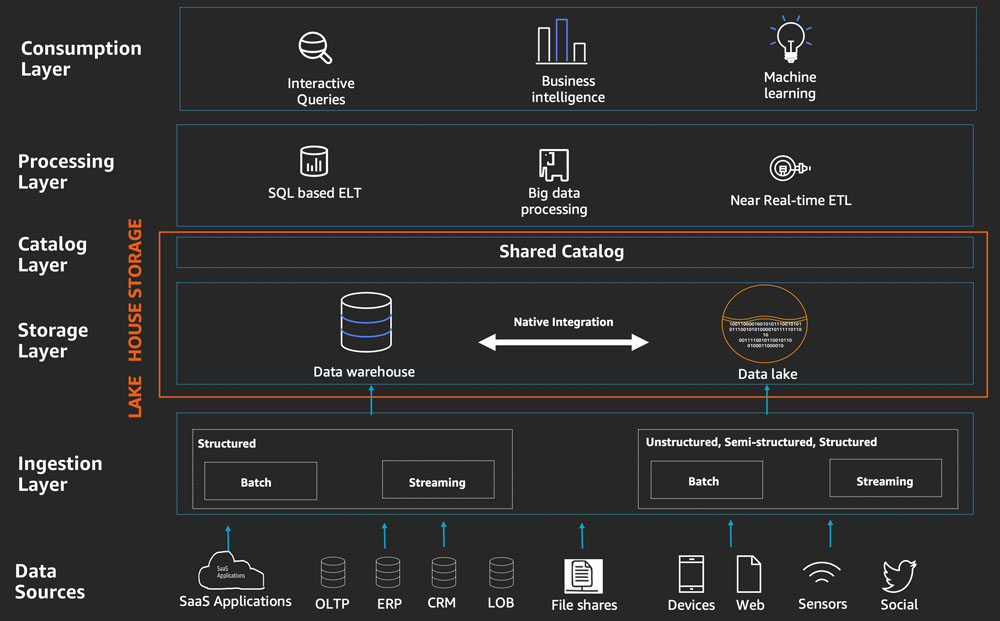

ķĆÜĶ┐ćÕ░åõĖŹÕÉīń╗ōµ×äŃĆüõĖŹÕÉīń▒╗Õ×ŗŃĆüõĖŹÕÉīµØźµ║ÉńÜäńøĖÕģ│µĢ░µŹ«µ▒ćµĆ╗ĶĄĘµØźÕ╣ČÕŖĀõ╗źÕłåµ×É’╝īńö©µłĘĶāĮÕż¤ÕŠŚÕć║µø┤µĘ▒Õł╗ŃĆüµø┤õĖ░Õ»īńÜäµ┤×Õ»¤Ķ¦üĶ¦ŻŃĆéõĖ║µŁż’╝īńö©µłĘķ£ĆĶ”üõ╗ÄõĖŹÕÉīÕŁżÕ▓øõĖŁĶÄĘÕÅ¢µēƵ£ēµĢ░µŹ«ŃĆüÕ░åÕģČĶüÜÕÉłĶć│ń╗¤õĖĆõĮŹńĮ«’╝łõ╣¤Õ░▒µś»õ║║õ╗¼ÕĖĖĶ»┤ńÜäŃĆīµĢ░µŹ«µ╣¢ŃĆŹ’╝ē’╝īÕåŹõ╗źµŁżõĖ║Õ¤║ńĪƵē¦ĶĪīÕłåµ×ÉõĖĵ£║ÕÖ©ÕŁ”õ╣ĀŃĆéõĮåÕ£©ÕģČõ╗¢ńö©õŠŗõĖŁ’╝īńö©µłĘõ╣¤õ╝ÜÕ░åµĢ░µŹ«µöŠńĮ«Õ£©ÕģČõ╗¢õĖōńö©ÕŁśÕé©õĮōń│╗õ╣ŗÕåģ’╝īõŠŗÕ”éÕŁśÕé©Õ£©µĢ░µŹ«õ╗ōÕ║ōÕåģõ╗źķÆłÕ»╣ń╗ōµ×äÕī¢µĢ░µŹ«µē¦ĶĪīÕżŹµØ鵤źĶ»óÕ╣ČÕ┐½ķƤĶÄĘÕŠŚń╗ōµ×£’╝øµł¢ĶĆģÕŁśÕé©Õ£©µÉ£ń┤óµ£ŹÕŖĪõĖŁõ╗źÕ┐½ķƤµÉ£ń┤ó/Õłåµ×ɵŚźÕ┐ŚµĢ░µŹ«’╝īĶ┐øĶĆīńøæµÄ¦ńö¤õ║¦ń│╗ń╗¤ńÜäĶ┐ÉĶĪīńŖČÕåĄŃĆ鵌ĀĶ«║Õ”éõĮĢ’╝īĶ”üµā│õ╗ÄĶ┐Öõ║øµĢ░µŹ«õĖŁĶÄĘÕÅ¢µ£ĆõĮ│µ┤×Ķ¦ü’╝īńö©µłĘÕ┐ģķĪ╗µ£ēĶāĮÕŖøĶĮ╗µØŠÕ£©µĢ░µŹ«µ╣¢õĖÄõĖōńö©ÕŁśÕé©ń│╗ń╗¤õ╣ŗķŚ┤ń¦╗ÕŖ©µĢ░µŹ«ŃĆéõĮåķÜÅńØĆń│╗ń╗¤õĖŁµĢ░µŹ«Ķ¦äµ©ĪńÜäµīüń╗ŁÕó×ķĢ┐’╝īµĢ░µŹ«ń¦╗ÕŖ©õ╣¤ÕÅśÕŠŚĶČŖµØźĶČŖÕø░ķÜŠŃĆéõĖ║õ║åĶ¦ŻÕå│Ķ┐ÖõĖƵīæµłśŃĆüĶ┐øĶĆīõ╗ĵĢ░µŹ«õĖŁĶÄĘÕÅ¢µ£ĆÕż¦µöČńøŖ’╝īõ║Üķ®¼ķĆŖõ║æń¦æµŖƵÅÉÕć║õ║åLake HouseŌĆ£µÖ║ĶāĮµ╣¢õ╗ōŌĆص¢╣µĪłŃĆé

Õ£©µ£¼µ¢ćõĖŁ’╝īµłæõ╗¼Õ░åÕģ▒ÕÉīõ║åĶ¦ŻÕ”éõĮĢÕ£©õ║Üķ®¼ķĆŖõ║æń¦æµŖĆńÜäõ║æÕ╣│ÕÅ░õĖŖµ×äÕ╗║µÖ║ĶāĮµ╣¢õ╗ō’╝īÕƤµŁżõ╗ĵīćµĢ░ń║¦Õó×ķĢ┐ńÜ䵥ĘķćŵĢ░µŹ«õĖŁĶÄĘÕÅ¢µ┤×Ķ¦ü’╝īÕ╣ČÕĖ«ÕŖ®µé©Õ┐½ķƤńüĄµ┤╗ÕüÜÕć║Õå│ńŁ¢ŃĆéĶ┐ÖÕźŚµÖ║ĶāĮµ╣¢õ╗ōµ¢╣µĪłķ”¢ÕģłµīćÕ«ÜõĖŁÕż«µĢ░µŹ«µ╣¢’╝īÕåŹÕø┤ń╗ĢµĢ░µŹ«µ╣¢Õ╗║ń½ŗõĖōńö©µĢ░µŹ«µ£ŹÕŖĪńÄ»’╝īÕÉīµŚČµÅÉõŠøĶĮ╗µØŠµśōĶĪīńÜäµĢ░µŹ«ÕŠĆµØźń¦╗ÕŖ©ĶāĮÕŖø’╝īÕĖ«ÕŖ®ńö©µłĘõ╗ÄÕ«╣Ķ┐Éńö©µĢ░µŹ«ĶĄäµ║Éõ╗źÕÅŖĶĢ┤ĶŚÅÕģČõĖŁńÜäķćŹĶ”üõ╗ĘÕĆ╝ŃĆé

µÖ║ĶāĮµ╣¢õ╗ōµ¢╣µĪł

õĮ£õĖ║õĖĆń▒╗ńÄ░õ╗ŻÕī¢µĢ░µŹ«µ×ȵ×ä’╝īµÖ║ĶāĮµ╣¢õ╗ōµ¢╣µ│ĢõĖŹõ╗ģÕ╝║Ķ░āÕ░åµĢ░µŹ«µ╣¢õĖĵĢ░µŹ«õ╗ōÕ║ōķøåµłÉĶĄĘµØź’╝īÕÉīµŚČõ╣¤µČēÕÅŖÕ░åµĢ░µŹ«µ╣¢ŃĆüµĢ░µŹ«õ╗ōÕ║ōõ╗źÕÅŖµēƵ£ēÕģČõ╗¢õĖōńö©µ£ŹÕŖĪµÄźÕģźń╗¤õĖĆõĖöĶ┐×ń╗ŁńÜäµĢ┤õĮōŃĆéµĢ░µŹ«µ╣¢õĖ║µłæõ╗¼µÅÉõŠøÕ»╣õĖ╗õĮōµĢ░µŹ«ńÜäÕłåµ×ÉńÄ»Õóā’╝īĶĆīõĖōńö©Õłåµ×ɵ£ŹÕŖĪÕłÖĶ┤¤Ķ┤Żõ╗źõ╗żõ║║µ╗ĪµäÅńÜäķƤÕ║”õĖ║µé©µÅÉõŠøÕģĘõĮōńö©õŠŗµö»µīü’╝łõŠŗÕ”éÕ«×µŚČõ╗¬ĶĪ©µØ┐õĖĵŚźÕ┐ŚÕłåµ×ÉÕŖ¤ĶāĮ’╝ēŃĆé

µ£¼µ¢ćõĖŁńÜäµÖ║ĶāĮµ╣¢õ╗ōµ¢╣µĪłÕīģÕɽõ╗źõĖŗÕćĀÕż¦Õģ│ķö«Ķ”üń┤Ā’╝Ü

┬ĘÕÅ»µē®Õ▒ĢµĢ░µŹ«µ╣¢

┬ĘõĖōńö©µĢ░µŹ«µ£ŹÕŖĪ

┬ʵŚĀń╝صĢ░µŹ«ń¦╗ÕŖ©

┬Ęń╗¤õĖƵ▓╗ńÉåµ£║ÕłČ

┬Ęķ½śµĢłńÄćõĮĵłÉµ£¼

õĖŗÕøŠµēĆńż║’╝īõĖ║ń£¤Õ«×Õ«óµłĘµĢ░µŹ«õĖÄÕĖĖĶ¦üµĢ░µŹ«Ķ┐üń¦╗ķ£Ćµ▒é’╝łÕīģµŗ¼µĢ░µŹ«Õłåµ×ɵ£ŹÕŖĪõĖĵĢ░µŹ«ÕŁśÕé©ķŚ┤ńÜäµĢ░µŹ«Ķ┐üń¦╗ŃĆüńö▒ÕåģÕÉæÕż¢ŃĆüńö▒Õż¢ÕÉæÕåģŃĆüÕæ©ĶŠ╣ń¦╗ÕŖ©ńŁēµāģÕåĄ’╝ēÕģ▒ÕÉīÕ╗║ń½ŗńÜäµÖ║ĶāĮµ╣¢õ╗ōµ¢╣µĪłŃĆé

Ķ┐ÖµĀĘõĖĆÕźŚÕłåÕ▒éõĖÄń╗äõ╗ČÕī¢µĢ░µŹ«Õłåµ×ɵ×ȵ×ä’╝īõĮ┐µé©ÕÅ»õ╗źķĆÜĶ┐浣ŻńĪ«ńÜäÕĘźÕģĘÕ«īµłÉµŁŻńĪ«ńÜäõ╗╗ÕŖĪ’╝īÕÉīµŚČµÅÉõŠøõ╗źĶ┐Łõ╗ŻÕÅŖÕó×ķćŵ¢╣Õ╝ŵ×äÕ╗║µ×ȵ×äńÜäĶē»ÕźĮµĢŵŹĘµĆ¦ŃĆéÕ£©µĘ╗ÕŖĀµ¢░µĢ░µŹ«µ║ÉŃĆüÕÅæńÄ░µ¢░ńÜäńö©õŠŗ/ķ£Ćµ▒éõ╗źÕÅŖÕ╝ĆÕÅæµ¢░ńÜäÕłåµ×ɵ¢╣µ│ĢµŚČ’╝īµłæõ╗¼ÕÅ»õ╗źµø┤ńüĄµ┤╗Õ£░Ķ░āµĢ┤µÖ║ĶāĮµ╣¢õ╗ōõĖŁńÜäńøĖÕ║öń╗äõ╗Č’╝īÕƤµŁżµ╗ĪĶČ│ÕĮōÕēŹÕÅŖµ£¬µØźńÜäÕÉäń▒╗ķ£Ćµ▒éŃĆé

Õ»╣õ║ĵłæõ╗¼ńÜäĶ┐ÖÕźŚµÖ║ĶāĮµ╣¢õ╗ōµ×ȵ×ä’╝īµé©ÕÅ»õ╗źµŖŖÕ«āń╗äń╗浳ÉõĖĆÕźŚõ║öÕ▒éķĆ╗ĶŠæÕĀåµĀł’╝īÕģČõĖŁÕÉäõĖ¬Õ▒éÕ»╣Õ║öńØĆĶ┤¤Ķ┤Żµ╗ĪĶČ│ńē╣Õ«Üķ£Ćµ▒éńÜäõĖōńö©ń╗äõ╗ČŃĆé

õĖŗķØó’╝īµłæõ╗¼Õ░åÕģĘõĮōõ╗ŗń╗ŹĶ┐Öõ║öõĖ¬Õ▒éń║¦ŃĆéõĮåÕ£©µŁżõ╣ŗÕēŹ’╝īõĖŹÕ”©ÕģłµØźĶüŖĶüŖµÖ║ĶāĮµ╣¢õ╗ōµ×ȵ×äńÜäµĢ░µŹ«µØźµ║ÉŃĆé

µĢ░µŹ«µ║É

Ķ┐ÖÕźŚµÖ║ĶāĮµ╣¢õ╗ōµ×ȵ×äÕÅ»õŠøµé©µæäÕÅ¢Õ╣ČÕłåµ×ÉµØźĶć¬õĖŹÕÉīµØźµ║ÉńÜäµĢ░µŹ«ŃĆ鵌ĀĶ«║µś»õĖÜÕŖĪń║┐’╝łLOB’╝ēÕ║öńö©ŃĆüERPÕ║öńö©Ķ┐śµś»CRMÕ║öńö©’╝īÕż¦ķā©ÕłåµĢ░µŹ«µ║ÉķāĮõ╝Üõ╗źÕø║Õ«ÜńÜäķŚ┤ķÜöńö¤µłÉķ½śÕ║”ń╗ōµ×äÕī¢ńÜäµē╣ķćŵĢ░µŹ«ŃĆéķÖżõ║åÕåģķā©ń╗ōµ×äÕī¢µØźµ║Éõ╣ŗÕż¢’╝īµé©Ķ┐śÕÅ»õ╗źõ╗ÄńÄ░õ╗ŻµĢ░µŹ«µ║É’╝łõŠŗÕ”éWebÕ║öńö©ń©ŗÕ║ÅŃĆüń¦╗ÕŖ©Ķ«ŠÕżćŃĆüõ╝Āµä¤ÕÖ©ŃĆüĶ¦åķóæµĄüõ╗źÕÅŖńżŠõ║żÕ¬ÆõĮōńŁē’╝ēÕżäµÄźµöȵĢ░µŹ«ŃĆéĶ┐Öõ║øńÄ░õ╗ŻµĢ░µŹ«µ║ÉÕŠĆÕŠĆõ╝Üõ╗źĶ┐×ń╗ŁµĢ░µŹ«µĄüµ¢╣Õ╝Åńö¤µłÉÕŹŖń╗ōµ×äÕī¢õ╣āĶć│ķØ×ń╗ōµ×äÕī¢µĢ░µŹ«ŃĆé

µĢ░µŹ«µæäÕÅ¢Õ▒é

µÖ║ĶāĮµ╣¢õ╗ōµ×ȵ×äõĖŁńÜäµæäÕÅ¢Õ▒é’╝īĶ┤¤Ķ┤ŻÕ░åµĢ░µŹ«µæäÕÅ¢Ķć│µÖ║ĶāĮµ╣¢õ╗ōńÜäÕŁśÕé©Õ▒éÕåģŃĆéÕ«āõ╝ÜÕƤÕŖ®ÕÉäń▒╗ÕŹÅĶ««µÄźÕģźÕåģķā©ÕÅŖÕż¢ķā©µĢ░µŹ«µ║É’╝īµē╣ķćŵł¢Õ«×µŚČµæäÕÅ¢µĢ░µŹ«’╝īÕåŹÕ░åń╗ōµ×£õ╝ĀķĆüĶć│µĢ░µŹ«õ╗ōÕ║ōõ╣āĶć│µÖ║ĶāĮµ╣¢õ╗ōÕŁśÕé©Õ▒éńÜäµĢ░µŹ«µ╣¢ń╗äõ╗ČõĖŁŃĆé

µĢ░µŹ«ÕŁśÕé©Õ▒é

µÖ║ĶāĮµ╣¢õ╗ōµ×ȵ×äõĖŁńÜäµĢ░µŹ«ÕŁśÕé©Õ▒é’╝īĶ┤¤Ķ┤ŻµÅÉõŠøµīüõ╣ģŃĆüÕÅ»µē®Õ▒ĢõĖöÕģʵ£ēĶē»ÕźĮµłÉµ£¼µĢłńøŖńÜäń╗äõ╗Č’╝īńö©õ╗źÕŁśÕé©ÕÅŖń«ĪńÉåÕż¦ķćŵĢ░µŹ«ŃĆéÕ£©µÖ║ĶāĮµ╣¢õ╗ōµ×ȵ×äõĖŁ’╝īµĢ░µŹ«õ╗ōÕ║ōõĖĵĢ░µŹ«µ╣¢Õ░åÕĤńö¤ķøåµłÉõ╗źµÅÉõŠøń╗ŵĄÄķ½śµĢłńÜäÕŁśÕé©Õ▒éõĮōń│╗’╝īńö©õ╗źµö»µīüķØ×ń╗ōµ×äÕī¢õ╗źÕÅŖķ½śÕ║”ń╗ōµ×äÕī¢ÕÆīÕ╗║µ©ĪµĢ░µŹ«ŃĆéÕŁśÕé©Õ▒éõ╝ܵīēńģ¦õĖŹÕÉīµČłĶ┤╣Õ░▒ń╗¬ńŖȵĆüÕ»╣ÕŁśÕ驵Ģ░µŹ«Ķ┐øĶĪīÕłÆÕłå’╝īÕģĘõĮōÕīģµŗ¼ÕĤզŗµĢ░µŹ«ŃĆüÕÅ»õ┐ĪµĢ░µŹ«ŃĆüõĖ░Õ»īµĢ░µŹ«õĖÄÕ╗║µ©ĪµĢ░µŹ«ŃĆé

µĢ░µŹ«õ╗ōÕ║ōõĖŁńÜäń╗ōµ×äÕī¢µĢ░µŹ«ÕŁśÕé©

µĢ░µŹ«õ╗ōÕ║ōõĖŁÕŁśÕé©ńÜ䵜»ń¼”ÕÉłµĀćÕćåõĖöķ½śÕ║”ÕÅ»õ┐ĪńÜäµĢ░µŹ«’╝īÕģĘõĮōń╗ōµ×äÕī¢ÕĮóÕ╝ÅÕłÖÕīģµŗ¼õ╝Āń╗¤ńÜ䵜¤ÕĮóŃĆüķø¬ĶŖ▒ÕĮóŃĆüµĢ░µŹ«õ┐Øń«ĪÕ║ōõ╣āĶć│ÕģČõ╗¢ķØ×Ķ¦äĶīāÕī¢µ©ĪÕ╝ÅŃĆéõ╗ōÕ║ōõĖŁÕŁśÕé©ńÜäµĢ░µŹ«ķĆÜÕĖĖĶÄĘÕÅ¢Ķć¬ķ½śÕ║”ń╗ōµ×äÕī¢ńÜäÕåģķā©õĖÄÕż¢ķā©µØźµ║É’╝łõŠŗÕ”éõ║żµśōń│╗ń╗¤ŃĆüÕģ│ń│╗µĢ░µŹ«Õ║ōõ╗źÕÅŖÕģČõ╗¢ń╗ōµ×äÕī¢Ķ┐ÉĶÉźĶĄäµ║É’╝ē’╝īĶĆīõĖöÕŠĆÕŠĆõ╗źõĖĆÕ«ÜńÜäĶ¦äÕŠŗõ┐صīüĶ┐ÉõĮ£ŃĆéńÄ░õ╗Żõ║æÕĤńö¤µĢ░µŹ«õ╗ōÕ║ōķĆÜÕĖĖĶāĮÕż¤Õ£©ÕåģńĮ«ńÜäķ½śµĆ¦ĶāĮÕŁśÕé©ÕŹĘõĖŁÕŁśµöŠń╗ÅĶ┐ćÕÄŗń╝®ńÜäPBń║¦ÕłŚÕ╝ŵĢ░µŹ«ŃĆéķĆÜĶ┐ćMPPÕ╝ĢµōÄķģŹÕÉłÕ┐½ķƤĶ┐׵ğķĆÜķüō’╝īńÄ░õ╗Żõ║æÕĤńö¤µĢ░µŹ«õ╗ōÕ║ōĶāĮÕż¤õĖ║ÕżŹµØéSQLµ¤źĶ»óµÅÉõŠøõĮÄÕ╗ČĶ┐¤õĖÄķ½śµē¦ĶĪīķƤÕ║”ŃĆé

õĖ║õ║åµÅÉõŠøń╗ÅĶ┐ćõĖźµĀ╝ńŁøķĆēŃĆüõĖĆĶć┤õĖöÕÅŚõ┐ĪńÜäµĢ░µŹ«’╝īÕ£©Õ░åµĢ░µŹ«ÕŁśÕé©Ķć│õ╗ōÕ║ōõ╣ŗÕēŹ’╝īµé©ķ£ĆĶ”üķ”¢ÕģłķĆÜĶ┐ćµÅÉÕÅ¢ŃĆüĶĮ¼µŹóŃĆüÕŖĀĶĮĮ’╝łETL’╝ēµł¢ĶĆģµÅÉÕÅ¢ŃĆüÕŖĀĶĮĮŃĆüĶĮ¼µŹó’╝łELT’╝ēń«ĪķüōÕ»╣µ║ɵĢ░µŹ«Ķ┐øĶĪīķóäÕżäńÉåŃĆüķ¬īĶ»üÕÅŖĶĮ¼µŹó’╝īÕƤµŁżÕ╗║ń½ŗĶĄĘĶĘ©õĖÜÕŖĪÕ¤¤ńÜäķ½śÕÅ»õ┐ĪÕ║”ń£¤Õ«×µĢ░µŹ«ķøåµ║ÉŃĆé

µÖ║ĶāĮµ╣¢õ╗ōµ×ȵ×äõĖŁńÜäń╗ōµ×äÕī¢õĖÄķØ×ń╗ōµ×äÕī¢µĢ░µŹ«ÕŁśÕé©

µĢ░µŹ«µ╣¢’╝īµś»õĖĆÕźŚńö©õ║ÄÕŁśÕé©Õ╣Čń╗äń╗ćµēƵ£ēµĢ░µŹ«ńÜäķøåõĖŁÕ╝ŵĢ░µŹ«ÕŁśÕé©Õ║ōŃĆéÕ«āµö»µīüõ╗źń╗ōµ×äÕī¢ŃĆüÕŹŖń╗ōµ×äÕī¢õ╗źÕÅŖķØ×ń╗ōµ×äÕī¢ńŁēÕĮóÕ╝ÅÕŁśÕ驵Ģ░µŹ«’╝īµö»µīüÕłåÕ▒éÕŁśÕé©õ╗źķ½śÕ║”õ╝śÕī¢µłÉµ£¼’╝īÕÉīµŚČÕÅ»Ķć¬ÕŖ©µē®Õ▒Ģõ╗źÕ«╣ń║│EBń║¦µĄĘķćŵĢ░µŹ«ŃĆéÕĖĖĶ¦üńÜäµĢ░µŹ«µ╣¢Ķó½ÕłÆÕłåõĖ║ńÖ╗ķÖåÕī║ŃĆüÕĤզŗÕī║ŃĆüÕÅŚõ┐ĪÕī║õĖÄńŁ¢ÕłÆÕī║ÕćĀõĖ¬ķā©Õłå’╝īńö©õ║ĵĀ╣µŹ«µĢ░µŹ«ńÜäµČłĶ┤╣Õ░▒ń╗¬ńŖȵĆüĶ┐øĶĪīÕłåÕł½ÕŁśÕé©ŃĆéķĆÜÕĖĖ’╝īµĢ░µŹ«Õ£©µæäÕÅ¢Õ«īµłÉÕÉÄõ╝ÜĶó½ÕĤµĀĘÕŁśÕé©Õ£©µĢ░µŹ«µ╣¢Õåģ’╝łµŚĀķ£ĆķóäÕģłÕ«Üõ╣ēschema’╝ē’╝īÕƤµŁżÕŖĀÕ┐½µæäÕÅ¢ķƤÕ║”Õ╣Čń╝®ń¤ŁµĢ░µŹ«µÄóń┤óõ╣ŗÕēŹńÜäÕćåÕżćµŚČķŚ┤ŃĆéµĢ░µŹ«µ╣¢ÕÅ»õ╗źķĆÜĶ┐ćÕżÜń¦Źµ¢╣µ│Ģ’╝łÕīģµŗ¼Õż¦µĢ░µŹ«ÕżäńÉåõĖĵ£║ÕÖ©ÕŁ”õ╣Ā’╝ēÕ»╣ÕÉäń▒╗µĢ░µŹ«ķøåĶ┐øĶĪīÕłåµ×ÉŃĆéµĢ░µŹ«µ╣¢õĖĵĢ░µŹ«õ╗ōÕ║ōķŚ┤ńÜäÕĤńö¤ķøåµłÉ’╝īĶ┐śÕģüĶ«Ėµé©õ╗Äõ╗ōÕ║ōÕŁśÕé©õĖŁń¦╗Õć║Õż¦ķćÅĶ«┐ķŚ«ķóæńÄćĶŠāõĮÄńÜäÕÄåÕÅ▓µĢ░µŹ«’╝īÕƤµŁżķÖŹõĮÄÕŁśÕ驵łÉµ£¼ŃĆé

ńø«ÕĮĢÕ▒é

ńø«ÕĮĢÕ▒éĶ┤¤Ķ┤ŻÕŁśÕ驵Ö║ĶāĮµ╣¢õ╗ōÕŁśÕé©Õ▒éÕåģµēƵēśń«ĪµĢ░µŹ«ķøåńÜäõĖÜÕŖĪõĖĵŖƵ£»ÕģāµĢ░µŹ«ŃĆéÕ£©µÖ║ĶāĮµ╣¢õ╗ōµ×ȵ×äõĖŁ’╝īńø«ÕĮĢńö▒µĢ░µŹ«µ╣¢õĖĵĢ░µŹ«õ╗ōÕ║ōÕģ▒õ║½’╝īÕ╣ČÕģüĶ«Ėńö©µłĘń╝¢ÕåÖµ¤źĶ»óŃĆéĶ┐Öõ║øµ¤źĶ»óÕ░åµŖŖÕŁśÕé©Õ£©µĢ░µŹ«µ╣¢õĖĵĢ░µŹ«õ╗ōÕ║ōÕåģńÜäµĢ░µŹ«ÕÉłÕ╣ČĶć│ÕÉīõĖĆSQLõĖŁ’╝īńö▒µŁżĶʤĶĖ¬ńēłµ£¼Õī¢schemaõĖĵĢ░µŹ«ķøåńÜäń╗åń▓ÆÕ║”ÕłåÕī║õ┐Īµü»ŃĆéķÜÅńØƵĢ░µŹ«ķøåµĢ░ķćÅńÜäÕó×ÕŖĀ’╝īĶ»źÕ▒éĶ┐śµÅÉõŠøµÉ£ń┤óÕŖ¤ĶāĮõ╗źõ┐ØĶ»üµÖ║ĶāĮµ╣¢õ╗ōõĖŁńÜäµĢ░µŹ«ķøåÕ¦ŗń╗łÕÅ»Ķó½ÕÅæńÄ░õĖĵ¤źĶ»óŃĆé

µÖ║ĶāĮµ╣¢õ╗ōµÄźÕÅŻ

Õ£©µÖ║ĶāĮµ╣¢õ╗ōµ×ȵ×äõĖŁ’╝īµĢ░µŹ«õ╗ōÕ║ōõĖĵĢ░µŹ«µ╣¢Õ£©ÕŁśÕé©õ╣āĶć│Õģ¼Õģ▒ńø«ÕĮĢÕ▒éõĖŖõ┐صīüÕĤńö¤ķøåµłÉ’╝īÕøĀµŁżĶāĮÕż¤õĖ║ÕżäńÉåÕÅŖµČłĶ┤╣Õ▒éµÅÉõŠøń╗¤õĖĆńÜäµÖ║ĶāĮµ╣¢õ╗ōµÄźÕÅŻŃĆéõ╗źµŁżõĖ║Õ¤║ńĪĆ’╝īµÖ║ĶāĮµ╣¢õ╗ōńÜäÕżäńÉåõĖĵȳĶ┤╣Õ▒éń╗äõ╗ČÕÅłÕÅ»õ╗źķĆÜĶ┐ćń╗¤õĖĆńÜäÕŹĢõĖ¬µÖ║ĶāĮµ╣¢õ╗ōµÄźÕÅŻ’╝łõŠŗÕ”éSQLµł¢Spark’╝ēõĮ┐ńö©ÕŁśÕé©Õ▒éÕåģÕŁśÕé©ńÜäµēƵ£ēµĢ░µŹ«’╝łÕłåÕł½ÕŁśÕé©Õ£©µĢ░µŹ«õ╗ōÕ║ōõĖĵĢ░µŹ«µ╣¢Õåģ’╝ēŃĆéĶ┐ÖµĀĘńÜäµ×ȵ×äĶ«ŠĶ«Ī’╝īõĮ┐µé©µŚĀķ£Ćµ▓┐õ╗╗õĖƵ¢╣ÕÉæÕ£©µĢ░µŹ«õ╗ōÕ║ōÕÅŖµĢ░µŹ«µ╣¢õ╣ŗķŚ┤ń¦╗ÕŖ©µĢ░µŹ«’╝īÕŹ│ÕÅ»Ķ«┐ķŚ«µÖ║ĶāĮµ╣¢õ╗ōõĖŁńÜäµēƵ£ēÕŁśÕ驵Ģ░µŹ«ŃĆé

µĢ░µŹ«õ╗ōÕ║ōõĖĵĢ░µŹ«µ╣¢ķŚ┤ńÜäÕĤńö¤ķøåµłÉ’╝īõĮ┐µé©ÕŠŚõ╗źńüĄµ┤╗µē¦ĶĪīõ╗źõĖŗµōŹõĮ£’╝Ü

┬ĘÕ░åEBń║¦Õł½ńÜäń╗ōµ×äÕī¢õĖÄķØ×ń╗ōµ×äÕī¢µĢ░µŹ«ÕŁśÕé©Õ£©µ×üÕģʵłÉµ£¼µĢłńøŖńÜäµĢ░µŹ«µ╣¢õ╣ŗÕåģ’╝īÕÉīµŚČÕ░åń╗ÅĶ┐ćķ½śÕ║”ńŁ¢ÕłÆŃĆüÕ╗║µ©ĪõĖĵĢ┤ÕÉłńÜäń╗ōµ×äÕī¢µĢ░µŹ«ÕŁśÕé©Õ£©ńāŁµĢ░µŹ«õ╗ōÕ║ōÕŁśÕé©ÕåģŃĆé

┬ĘÕł®ńö©SparkńŁēÕŹĢõĖĆÕżäńÉåµĪåµ×ČķĆÜĶ┐ćÕŹĢõĖĆń«ĪķüōÕÉłÕ╣ČÕ╣ČÕłåµ×ɵēƵ£ēµĢ░µŹ«’╝īÕīģµŗ¼µĢ░µŹ«µ╣¢õĖŁńÜäķØ×ń╗ōµ×äÕī¢µĢ░µŹ«õĖĵĢ░µŹ«õ╗ōÕ║ōõĖŁńÜäń╗ōµ×äÕī¢µĢ░µŹ«ŃĆé

┬ʵ×äÕ╗║Õ¤║õ║ÄSQLńÜäµĢ░µŹ«õ╗ōÕ║ōÕĤńö¤ETLµł¢ELTń«Īķüō’╝īÕ░åõ╗ōÕ║ōõĖŁńÜäÕ╣│ķØóÕģ│ń│╗µĢ░µŹ«õĖĵĢ░µŹ«µ╣¢ÕåģÕżŹµØéńÜäÕżÜÕ▒éń╗ōµ×äÕī¢µĢ░µŹ«ńøĖń╗ōÕÉłŃĆé

µĢ░µŹ«ÕżäńÉåÕ▒é

µÖ║ĶāĮµ╣¢õ╗ōµ×ȵ×äńÜäµĢ░µŹ«ÕżäńÉåÕ▒éń╗äõ╗ČĶ┤¤Ķ┤ŻķĆÜĶ┐ćķ¬īĶ»üŃĆüµĖģµ┤ŚŃĆüĶ¦äĶīāÕī¢ŃĆüĶĮ¼µŹóõĖĵē®ÕģģńŁēµ¢╣Õ╝ÅÕ░åµĢ░µŹ«ĶĮ¼µŹóõĖ║ÕÅ»µČłĶ┤╣ńŖȵĆüŃĆéÕżäńÉåÕ▒éµÅÉõŠøõĖōńö©ń╗äõ╗ȵē¦ĶĪīÕÉäń▒╗ĶĮ¼µŹó’╝īÕīģµŗ¼µĢ░µŹ«õ╗ōÕ║ōSQLŃĆüÕż¦µĢ░µŹ«ÕżäńÉåõ╗źÕÅŖĶ┐æÕ«×µŚČETLńŁēŃĆé

ÕżäńÉåÕ▒éµÅÉõŠøõĖĵŁŻńĪ«ńÜäµĢ░µŹ«ķøåńē╣ÕŠü’╝łÕīģµŗ¼Õż¦Õ░ÅŃĆüµĀ╝Õ╝ÅŃĆüschemaŃĆüķƤÕ║”’╝ēŃĆüÕĮōÕēŹÕżäńÉåõ╗╗ÕŖĪõ╗źÕÅŖÕÅ»ńö©µŖƵ£»ķøå’╝łSQLŃĆüSpark’╝ēńøĖÕī╣ķģŹńÜäõĖōńö©ń╗äõ╗Č’╝īńö▒µŁżÕ░ĮÕÅ»ĶāĮÕŖĀÕ┐½õ║żõ╗śķƤÕ║”ŃĆéÕżäńÉåÕ▒éĶāĮÕż¤ń╗ŵĄÄķ½śµĢłÕ£░µē®Õ▒Ģõ╗źÕżäńÉåÕż¦ķćŵĢ░µŹ«’╝īÕÉīµŚČµö»µīüschema-on-writeŃĆüschema-on-readŃĆüÕłåÕī║µĢ░µŹ«ķøåõ╗źÕÅŖÕżÜń¦ŹµĢ░µŹ«µĀ╝Õ╝ÅŃĆéÕżäńÉåÕ▒éĶ┐śĶāĮÕż¤Ķ«┐ķŚ«ń╗¤õĖĆńÜäµÖ║ĶāĮµ╣¢õ╗ōÕŁśÕ驵ğÕÅŻõĖÄķĆÜńö©ńø«ÕĮĢ’╝īńö▒µŁżĶ«┐ķŚ«µÖ║ĶāĮµ╣¢õ╗ōõĖŁńÜäµēƵ£ēµĢ░µŹ«ÕÅŖÕģāµĢ░µŹ«’╝īĶ┐øĶĆīÕ«×ńÄ░õ╗źõĖŗõ╝śÕŖ┐’╝Ü

┬Ęķü┐ÕģŹÕłåµ×ÉÕżäńÉåµĢ░µŹ«µ╣¢õĖĵĢ░µŹ«õ╗ōÕ║ōµŚČÕÅ»ĶāĮÕ»╝Ķć┤ńÜäµĢ░µŹ«ÕåŚõĮÖŃĆüķØ×Õ┐ģĶ”üµĢ░µŹ«ń¦╗ÕŖ©õ╗źÕÅŖETLõ╗ŻńĀüķćŹÕżŹŃĆé

┬ĘÕŖĀÕ┐½õ║żõ╗śķƤÕ║”ŃĆé

µĢ░µŹ«µČłĶ┤╣Õ▒é

µÖ║ĶāĮµ╣¢õ╗ōµ×ȵ×äõĖŁńÜäµĢ░µŹ«µČłĶ┤╣Õ▒éĶ┤¤Ķ┤ŻµÅÉõŠøÕÅ»µē®Õ▒ĢńÜäķ½śµĆ¦ĶāĮń╗äõ╗Č’╝īÕł®ńö©ń╗¤õĖĆńÜäµÖ║ĶāĮµ╣¢õ╗ōµÄźÕÅŻĶ«┐ķŚ«ÕŁśÕé©Õ▒éõĖŁńÜäµĢ░µŹ«õ╗źÕÅŖńø«ÕĮĢõĖŁńÜäÕģāµĢ░µŹ«ŃĆéµĢ░µŹ«µČłĶ┤╣Õ▒éĶ┐śµÅÉõŠøõĖōńö©Õłåµ×Éń╗äõ╗Čõ╗źÕģ©ķØóÕ╝ƵöŠÕłåµ×ÉÕŖ¤ĶāĮ’╝īńĪ«õ┐Øń╗äń╗ćÕåģńÜäµēƵ£ēĶüīĶāĮĶ¦ÆĶē▓ķāĮĶāĮÕż¤ķĆÜĶ┐ćõ║żõ║ÆÕ╝ÅSQLµ¤źĶ»óŃĆüõ╗ōÕ║ōÕ╝ÅÕłåµ×ÉŃĆüÕĢåÕŖĪµÖ║ĶāĮõ╗¬ĶĪ©µØ┐õ╗źÕÅŖµ£║ÕÖ©ÕŁ”õ╣ĀńŁēÕĮóÕ╝ÅĶÄĘÕÅ¢µ┤×Õ»¤Ķ¦üĶ¦ŻŃĆé

µČłĶ┤╣Õ▒éõĖŁńÜäń╗äõ╗ȵö»µīüõ╗źõĖŗÕŖ¤ĶāĮ’╝Ü

┬Ęń╝¢ÕåÖµ¤źĶ»óõĖÄÕłåµ×É/µ£║ÕÖ©ÕŁ”õ╣ĀõĮ£õĖÜ’╝īĶ«┐ķŚ«ÕÅŖÕÉłÕ╣ČµØźĶć¬õ╝Āń╗¤µĢ░µŹ«õ╗ōÕ║ōńÜäń╗┤Õ║”schemaõ╗źÕÅŖµĢ░µŹ«µ╣¢µēśń«ĪĶĪ©’╝łķ£ĆĶ”üķģŹÕÉłschema-on-read’╝ēŃĆé

┬ĘÕżäńÉåõ╗źÕÉäń¦ŹÕ╝ƵöŠµ¢ćõ╗ȵĀ╝Õ╝Å’╝łõŠŗÕ”éAvroŃĆüParquetµł¢ĶĆģORC’╝ēÕŁśÕé©ńÜäµĢ░µŹ«µ╣¢µēśń«ĪµĢ░µŹ«ķøåŃĆé

┬ĘÕ£©Ķ»╗ÕÅ¢µĢ░µŹ«µ╣¢õĖŁµēśń«ĪńÜäÕż¦Õ×ŗÕłåÕī║µĢ░µŹ«ķøåµŚČ’╝īķĆÜĶ┐ćÕłåÕī║ĶŻüÕē¬õ╝śÕī¢µĆ¦ĶāĮõĖĵłÉµ£¼ŃĆé

Õ£©µ£¼µ¢ćńÜäÕÉÄń╗Łķā©Õłå’╝īµłæõ╗¼Õ░åõ╗ŗń╗ŹõĖĆÕźŚÕÅéĶĆāµ×ȵ×ä’╝īÕ▒Ģńż║Õ”éõĮĢõĮ┐ńö©õ║Üķ®¼ķĆŖõ║æń¦æµŖƵ£ŹÕŖĪµ×äÕ╗║µÖ║ĶāĮµ╣¢õ╗ōķĆ╗ĶŠæµ×ȵ×äõĖŁńÜäÕÉäõĖ¬Õ▒éŃĆéÕ£©Ķ┐ÖÕźŚµ¢╣µĪłõĖŁ’╝īõ║Üķ®¼ķĆŖõ║æń¦æµŖƵ£ŹÕŖĪÕ░åµēśń«Īõ╗źõĖŗÕĘźõĮ£’╝Ü

┬ʵÅÉõŠøÕ╣Čń«ĪńÉåÕÅ»µē®Õ▒ĢŃĆüÕģʵ£ēĶē»ÕźĮÕ╝╣µĆ¦ŃĆüÕ«ēÕģ©õĖöµłÉµ£¼µĢłńøŖÕć║Ķē▓ńÜäÕ¤║ńĪĆĶ«Šµ¢Įń╗äõ╗ČŃĆé

┬ĘńĪ«õ┐ØÕÉäÕ¤║ńĪĆĶ«Šµ¢Įń╗äõ╗ČÕĮ╝µŁżÕĤńö¤ķøåµłÉŃĆé

Ķ┐ÖÕźŚµ¢╣µĪłÕ░åÕĖ«ÕŖ®µé©Õ░åõĖ╗Ķ”üń▓ŠÕŖøķøåõĖŁÕ£©õ╗źõĖŗÕĘźõĮ£Ķ║½õĖŖ’╝Ü

┬ĘÕ┐½ķƤÕ╗║ń½ŗµĢ░µŹ«õĖÄÕłåµ×Éń«ĪķüōŃĆé

┬ʵśŠĶæŚÕŖĀÕ┐½µ¢░µĢ░µŹ«ńÜäÕ»╝ÕģźķƤÕ║”’╝īÕ╣Čõ╗ĵĢ░µŹ«õĖŁĶÄĘÕÅ¢µ┤×Ķ¦üŃĆé

┬ʵö»µīüÕżÜõĖ¬ńö©µłĘĶ¦ÆĶē▓ŃĆé

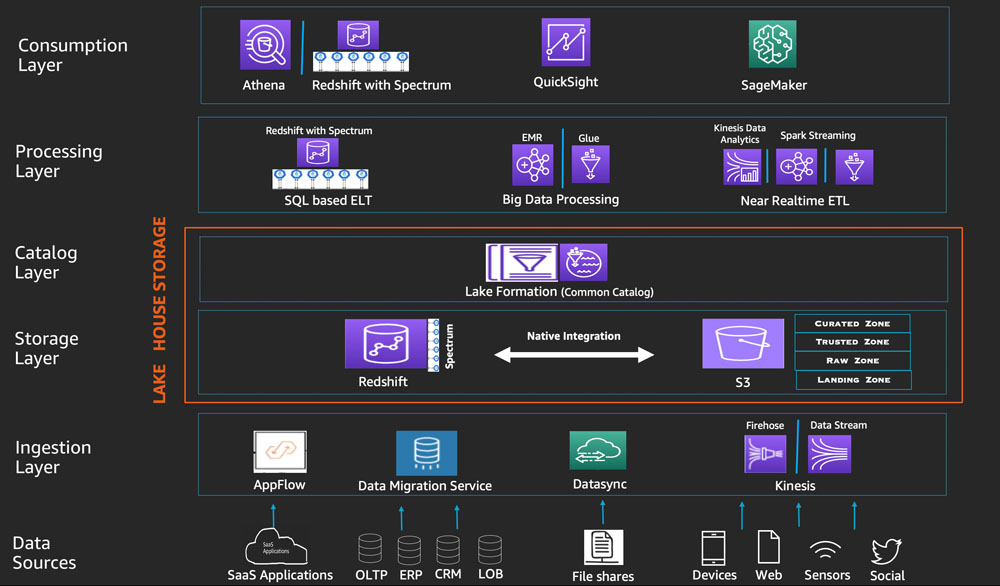

õ║Üķ®¼ķĆŖõ║æń¦æµŖĆÕ╣│ÕÅ░õĖŖńÜäµÖ║ĶāĮµ╣¢õ╗ōÕÅéĶĆāµ×ȵ×ä

õĖŗÕøŠµēĆńż║’╝īõĖ║õ║Üķ®¼ķĆŖõ║æń¦æµŖĆÕ╣│ÕÅ░õĖŖńÜäµÖ║ĶāĮµ╣¢õ╗ōÕÅéĶĆāµ×ȵ×äŃĆé

Õ£©õ╗źõĖŗń½ĀĶŖéõĖŁ’╝īµłæõ╗¼Õ░åÕģĘõĮōõ╗ŗń╗ŹÕÉäķĆ╗ĶŠæÕ▒éńÜäń╗åĶŖéõ┐Īµü»ŃĆé

µĢ░µŹ«µæäÕÅ¢Õ▒é

µÖ║ĶāĮµ╣¢õ╗ōÕÅéĶĆāµ×ȵ×äõĖŁńÜäµæäÕÅ¢Õ▒éÕīģÕɽõĖĆń╗äõĖōńö©ńÜäõ║Üķ®¼ķĆŖõ║æń¦æµŖƵ£ŹÕŖĪ’╝īĶ┤¤Ķ┤ŻÕ░åõĖŹÕÉīµØźµ║ÉńÜäµĢ░µŹ«µæäÕÅ¢Ķć│µÖ║ĶāĮµ╣¢õ╗ōÕŁśÕé©Õ▒éÕåģŃĆéÕż¦ķā©ÕłåµæäÕÅ¢µ£ŹÕŖĪĶāĮÕż¤ńø┤µÄźÕ░åµĢ░µŹ«õ╝ĀķĆÆĶć│µĢ░µŹ«µ╣¢õĖĵĢ░µŹ«õ╗ōÕ║ōÕŁśÕé©ŃĆ鵣żÕż¢’╝īÕģČõĖŁõĮ┐ńö©ńÜäÕ«ÜÕłČÕī¢õĖōńö©µ£ŹÕŖĪĶ┐śĶāĮÕģģÕłåµ╗ĪĶČ│õ╗źõĖŗµØźµ║ÉńÜäĶ┐׵ğµĆ¦ŃĆüµĢ░µŹ«µĀ╝Õ╝ÅŃĆüµĢ░µŹ«ń╗ōµ×äõĖĵĢ░µŹ«ķƤÕ║”ńŁēÕģĘõĮōĶ”üµ▒é’╝Ü

┬ĘĶ┐ÉĶÉźµĢ░µŹ«Õ║ōµ║É

┬ĘĶĮ»õ╗ČÕŹ│µ£ŹÕŖĪ’╝łSaaS’╝ēÕ║öńö©ń©ŗÕ║Å

┬ʵ¢ćõ╗ČÕģ▒õ║½

┬ʵĄüÕ╝ŵĢ░µŹ«µ║É

Ķ┐ÉĶÉźµĢ░µŹ«Õ║ōµ║É’╝łOLTPŃĆüERPŃĆüCRMńŁē’╝ē

µæäÕÅ¢Õ▒éõĖŁńÜäAWS Data Migration Service(AWS DMS)ń╗äõ╗ČĶāĮÕż¤µÄźÕģźÕżÜõĖ¬Ķ┐ÉĶÉźRDBMSõĖÄNoSQLµĢ░µŹ«Õ║ō’╝īÕ╣ČÕ░åÕģČõĖŁńÜäµĢ░µŹ«µæäÕÅ¢Ķć│µĢ░µŹ«µ╣¢ÕåģńÜäAmazon Simple Storage Service(Amazon S3)ÕŁśÕ驵ĪČõĖŁ’╝īµł¢ĶĆģńø┤µÄźµæäÕÅ¢Ķć│Amazon RedshiftµĢ░µŹ«õ╗ōÕ║ōńÜästagingĶĪ©ŃĆéÕƤÕŖ®AWS DMS’╝īµé©ÕÅ»õ╗źõĖƵ¼ĪµĆ¦Õ»╝Õģźµ║ɵĢ░µŹ«’╝īńäČÕÉÄÕåŹÕżŹÕłČµ║ɵĢ░µŹ«Õ║ōńÜäµĢ░µŹ«µīüń╗ŁÕÅśÕī¢ŃĆé

SaaSÕ║öńö©ń©ŗÕ║Å

µæäÕÅ¢Õ▒éõĮ┐ńö©Amazon AppFlowĶĮ╗µØŠÕ░åSaaSÕ║öńö©ń©ŗÕ║ŵĢ░µŹ«µæäÕÅ¢Ķć│µé©ńÜäµĢ░µŹ«µ╣¢ÕåģŃĆéÕŬķ£ĆÕŹĢÕć╗ÕćĀõĖŗ’╝īµé©Õ░▒ÕÅ»õ╗źÕ£©Amazon AppFlowõĖŁĶ«ŠńĮ«µŚĀµ£ŹÕŖĪÕÖ©µĢ░µŹ«ĶÄĘÕÅ¢µĄüŃĆéµé©ńÜäµĢ░µŹ«µĄüÕÅ»õ╗źµÄźÕģźÕżÜń¦ŹSaaSÕ║öńö©ń©ŗÕ║Å’╝łõŠŗÕ”éSalesforceŃĆüMarketoõ╗źÕÅŖGoogle Analytics’╝ēŃĆüµæäÕÅ¢µĢ░µŹ«’╝īÕåŹÕ░åń╗ōµ×£õ╝ĀķĆÆĶć│µÖ║ĶāĮµ╣¢õ╗ōÕŁśÕé©Õ▒鵳¢ĶĆģµĢ░µŹ«µ╣¢ÕåģńÜäS3ÕŁśÕ驵ĪČ’╝īõ╣¤ÕÅ»õ╗źńø┤µÄźõ╝ĀķĆÆĶć│Amazon RedshiftµĢ░µŹ«õ╗ōÕ║ōõĖŁńÜästagingĶĪ©ŃĆéµé©ÕÅ»õ╗źĶ░āÕ║”Amazon AppFlowµæäÕÅ¢µĄü’╝īµł¢ĶĆģµĀ╣µŹ«SaaSÕ║öńö©ń©ŗÕ║ÅÕåģńÜäõ║ŗõ╗ČĶ┐øĶĪīÕŹ│µŚČĶ¦”ÕÅæŃĆéÕ£©Õ░åµæäÕÅ¢µĢ░µŹ«õ╝ĀķĆÆĶć│µÖ║ĶāĮµ╣¢õ╗ōÕŁśÕé©Õ▒éõ╣ŗÕēŹ’╝īµé©Ķ┐śÕÅ»õ╗źÕ»╣µĢ░µŹ«ÕåģÕ«╣ÕŖĀõ╗źķ¬īĶ»üŃĆüĶ┐ćµ╗żŃĆüµśĀÕ░äÕÅŖĶä▒µĢÅŃĆé

µ¢ćõ╗ČÕģ▒õ║½

ńøĖÕĮōõĖĆķā©ÕłåÕ║öńö©ń©ŗÕ║Åõ╝ÜÕ░åń╗ōµ×äÕī¢õĖÄķØ×ń╗ōµ×äÕī¢µĢ░µŹ«ÕŁśÕé©Õ£©µēśń«Īõ║ÄńĮæń╗£ķÖäÕŖĀÕŁśÕé©’╝łNAS’╝ēķśĄÕłŚõĖŖńÜäµ¢ćõ╗ČõĖŁŃĆéAWS DataSyncĶāĮÕż¤õ╗ÄÕÉ»ńö©NFSõĖÄSMBńÜäNASĶ«ŠÕżćõĖŁÕ┐½ķƤÕ░åµĢ░ńÖŠõĖćõĖ¬µ¢ćõ╗ČŃĆüµĢ░ńÖŠTBÕż¦Õ░ÅńÜäµĢ░µŹ«µæäÕÅ¢Ķć│µĢ░µŹ«µ╣¢ńÖ╗ķÖåÕī║ÕåģŃĆéDataSyncõĖŹõ╗ģĶāĮÕż¤Ķć¬ÕŖ©ÕżäńÉåÕżŹÕłČõĮ£õĖÜńÜäĶäܵ£¼ŃĆüĶ░āÕ║”Õ╣ČńøæµÄ¦ĶĮ¼ń¦╗Ķ┐ćń©ŗ’╝īĶ┐śĶāĮÕż¤ķ¬īĶ»üµĢ░µŹ«Õ«īµĢ┤µĆ¦Õ╣Čõ╝śÕī¢ńĮæń╗£ĶĄäµ║ÉÕł®ńö©ńÄćŃĆéÕ£©Õ«īµłÉõĖĆĶĮ«µ¢ćõ╗ČĶĮ¼ń¦╗õ╣ŗÕÉÄ’╝īDataSyncĶ┐śÕÅ»ńøæµÄ¦Õ╣ČÕ░åÕÉÄń╗ŁÕÅæńö¤ÕÅśµø┤ńÜäµ¢ćõ╗ČÕÉīµŁźĶć│µÖ║ĶāĮµ╣¢õ╗ōŃĆéµø┤ķćŹĶ”üńÜ䵜»’╝īDataSyncµś»õĖĆķĪ╣Õ«īÕģ©µēśń«Īµ£ŹÕŖĪ’╝īµĢ┤õĖ¬Ķ«ŠńĮ«Ķ┐ćń©ŗÕŬķ£ĆĶ”üÕćĀÕłåķƤŃĆé

µĄüÕ╝ŵĢ░µŹ«µ║É

µæäÕÅ¢Õ▒éõĮ┐ńö©Amazon Kinesis Data Firehoseõ╗ÄÕåģķā©µł¢Õż¢ķā©µ║ÉÕżäµÄźµöȵĄüÕ╝ŵĢ░µŹ«’╝īÕ╣ČÕ░åÕģČõ╝ĀķĆÆĶć│µÖ║ĶāĮµ╣¢õ╗ōÕŁśÕé©Õ▒éŃĆéÕŬķ£ĆÕŹĢÕć╗ÕćĀõĖŗ’╝īµé©Õ░▒ÕÅ»õ╗źķģŹńĮ«Kinesis Data Firehose APIń½»ńé╣’╝īõŠøµĢ░µŹ«µ║ÉÕÅæķĆüµĄüÕ╝ŵĢ░µŹ«ŌĆöŌĆöÕīģµŗ¼ńé╣Õć╗µĄüŃĆüÕ║öńö©ń©ŗÕ║ÅõĖÄÕ¤║ńĪĆĶ«Šµ¢ĮµŚźÕ┐ŚÕÅŖńøæµÄ¦µīćµĀć’╝īõ╗źÕÅŖĶ«ŠÕżćķüźµĄŗõĖÄõ╝Āµä¤ÕÖ©Ķ»╗µĢ░ńŁēńē®ĶüöńĮæµĢ░µŹ«ŃĆéKinesis Data FirehoseÕ░åµē¦ĶĪīõ╗źõĖŗµōŹõĮ£’╝Ü

┬Ęń╝ōÕå▓ĶŠōÕģźµĄüŃĆé

┬ĘÕ»╣µĢ░µŹ«Ķ┐øĶĪīÕłåµē╣ŃĆüÕÄŗń╝®ŃĆüĶĮ¼µŹóŃĆüÕłåÕī║õĖÄÕŖĀÕ»åŃĆé

┬ĘÕ░åµĢ░µŹ«õĮ£õĖ║S3Õ»╣Ķ▒Īõ╝ĀķĆÆĶć│µĢ░µŹ«µ╣¢’╝īµł¢õĮ£õĖ║ĶĪīõ╝ĀķĆÆĶć│Amazon RedshiftµĢ░µŹ«õ╗ōÕ║ōÕåģńÜästagingĶĪ©ŃĆé

Kinesis Data FirehoseõĖ║µŚĀµ£ŹÕŖĪÕÖ©µ£ŹÕŖĪ’╝īõĖŹķ£ĆĶ”üķóØÕż¢ń«ĪńÉåõĖöµÅÉõŠøµłÉµ£¼µ©ĪÕ×ŗ’╝īµé©ÕŬķ£ĆĶ”üõĖ║ķĆÜĶ┐ćĶ»źµ£ŹÕŖĪõ╝ĀĶŠōÕÅŖÕżäńÉåńÜäÕ«×ķÖģµĢ░µŹ«ķćÅõ╗śĶ┤╣ŃĆéKinesis Data Firehoseõ╝ÜĶć¬ÕŖ©õ╝Ėń╝®õ╗źķĆéÕ║öõ╝ĀÕģźµĢ░µŹ«ńÜäĶ¦äµ©ĪÕÅŖÕÉ×ÕÉÉķćÅŃĆéÕ£©µ×äÕ╗║Õ«×µŚČµĄüÕ╝ÅÕłåµ×Éń«Īķüōµ£¤ķŚ┤’╝īµæäÕÅ¢Õ▒éõ╝Üńø┤µÄźµÅÉõŠøAmazon Kinesis Data StreamsŃĆé

µÖ║ĶāĮµ╣¢õ╗ōÕŁśÕé©Õ▒é

Amazon RedshiftõĖÄAmazon S3õĖ║µ£¼µ¢ćõĖŁńÜäµÖ║ĶāĮµ╣¢õ╗ōÕÅéĶĆāµ×ȵ×äµÅÉõŠøõ║åń╗¤õĖĆńÜäÕĤńö¤ķøåµłÉÕŁśÕé©Õ▒éŃĆéõĖĆĶł¼ĶĆīĶ©Ć’╝īAmazon RedshiftĶ┤¤Ķ┤ŻÕŁśÕé©ķ½śÕ║”Ķ¦äĶīāÕī¢ŃĆüń¼”ÕÉłµĀćÕćåĶ”üµ▒éńÜäÕÅ»õ┐ĪµĢ░µŹ«’╝īĶ┐Öõ║øń╗ōµ×äÕī¢µĢ░µŹ«ķüĄÕŠ¬µĀćÕćåń╗┤Õ║”schema’╝øÕ»╣õ║ÄÕģČõ╗¢ń╗ōµ×äÕī¢ŃĆüÕŹŖń╗ōµ×äÕī¢õĖÄķØ×ń╗ōµ×äÕī¢µĢ░µŹ«’╝īÕłÖńö▒Amazon S3µÅÉõŠøEBń║¦Õł½ńÜäµĢ░µŹ«µ╣¢ÕŁśÕ驵ö»µīüŃĆéõĮåAmazon RedshiftÕÉīµĀʵö»µīüÕŹŖń╗ōµ×äÕī¢µĢ░µŹ«’╝īõŠøµé©Õ£©ÕģČõĖŁµæäÕÅ¢ÕÅŖÕŁśÕé©ÕŹŖń╗ōµ×äÕī¢µĢ░µŹ«ŃĆéAmazon S3ÕłÖµÅÉõŠøĶĪīõĖÜķóåÕģłńÜäÕÅ»µē®Õ▒ĢµĆ¦ŃĆüµĢ░µŹ«ÕÅ»ńö©µĆ¦ŃĆüÕ«ēÕģ©µĆ¦õĖĵƦĶāĮĶĪ©ńÄ░ŃĆéÕ╝ƵöŠµ¢ćõ╗ȵĀ╝Õ╝ÅÕģüĶ«Ėµé©õĮ┐ńö©ÕżÜń¦ŹÕżäńÉåÕÅŖµČłĶ┤╣Õ▒éń╗äõ╗ČÕ»╣ÕÉīõĖƵē╣Amazon S3µĢ░µŹ«µē¦ĶĪīÕłåµ×ÉŃĆéÕģ¼Õģ▒ńø«ÕĮĢÕ▒éÕ£©Amazon S3õĖŁĶ┤¤Ķ┤ŻÕŁśÕé©ń╗ōµ×äÕī¢µł¢ÕŹŖń╗ōµ×äÕī¢µĢ░µŹ«ķøåńÜäschemaŃĆéµČłĶ┤╣Ķ»źS3µĢ░µŹ«ķøåńÜäń╗äõ╗ČķĆÜÕĖĖõ╝ÜÕ£©Ķ»╗ÕÅ¢µĢ░µŹ«ķøåµŚČ’╝īÕ░åĶ┐Öõ║øschemaÕ║öńö©õ║ĵĢ░µŹ«ķøå’╝łÕŹ│schema-on-read’╝ēŃĆé

Amazon Redshift Spectrumµś»ÕĤńö¤ķøåµłÉµÖ║ĶāĮµ╣¢õ╗ōÕŁśÕé©Õ▒éõĖŁńÜäµĀĖÕ┐āń╗䵳Éķā©Õłåõ╣ŗõĖĆŃĆéRedshift SpectrumÕĖ«ÕŖ®Amazon RedshiftµÅÉõŠøõĖĆõĖ¬ń╗¤õĖĆńÜäSQLµÄźÕÅŻ’╝īńö©õ╗źµÄźµöČÕÅŖÕżäńÉåSQLĶ»ŁÕÅź’╝īÕ╣ČÕ£©ÕÉīõĖƵ¤źĶ»óÕåģÕ╝Ģńö©ÕÅŖÕÉłÕ╣ȵēśń«ĪÕ£©µĢ░µŹ«µ╣¢ÕÅŖµĢ░µŹ«õ╗ōÕ║ōÕåģńÜäµĢ░µŹ«ķøåŃĆéÕćŁÕƤµĢ░ÕŹāõĖ¬ń×¼µĆüRedshift SpectrumĶŖéńé╣ķģŹÕÉłAmazon RedshiftńÜäÕżŹµØ鵤źĶ»óõ╝śÕī¢ÕŖ¤ĶāĮ’╝īAmazon RedshiftĶāĮÕż¤ķ½śµĢłµ¤źĶ»óÕŁśÕé©Õ£©Amazon S3õĖŁńÜäPBń║¦µĢ░µŹ«ŃĆéRedshift SpectrumĶ┐śĶāĮÕż¤µ¤źĶ»óS3µĢ░µŹ«µ╣¢ÕåģńÜäÕłåÕī║µĢ░µŹ«’╝īÕīģµŗ¼Ķ»╗ÕÅ¢õĮ┐ńö©Õ╝Ƶ║Éń╝¢Ķ¦ŻńĀüÕÖ©ÕÄŗń╝®ńÜäµĢ░µŹ«’╝īÕ╣ȵö»µīüÕīģµŗ¼JSONŃĆüCSVŃĆüAvroŃĆüParquetŃĆüORCõ╗źÕÅŖApache HudiÕ£©ÕåģńÜäÕżÜń¦ŹÕ╝Ƶ║ÉĶĪīµł¢ÕłŚÕ╝ÅÕŁśÕé©ŃĆé

ÕĮōRedshift SpectrumĶ»╗ÕÅ¢ÕŁśÕé©Õ£©Amazon S3õĖŁńÜäµĢ░µŹ«ķøåµŚČ’╝īõ╝ÜÕ░åµØźĶć¬Õģ¼Õģ▒AWS Lake Formationńø«ÕĮĢńÜäńøĖÕ║öschemaÕ║öńö©õ║ĵĢ░µŹ«’╝łÕŹ│schema-on-read’╝ēŃĆéÕƤÕŖ®Redshift Spectrum’╝īµé©ÕÅ»õ╗źÕ╗║ń½ŗĶĄĘµē¦ĶĪīõ╗źõĖŗµōŹõĮ£ńÜäAmazon RedshiftÕĤńö¤ń«Īķüō’╝Ü

┬ĘõĮ┐ńö©Redshift SpectrumÕ░åÕż¦ķćÅÕÄåÕÅ▓µĢ░µŹ«õ┐ØńĢÖÕ£©µĢ░µŹ«µ╣¢Õåģ’╝īÕ╣ČÕ░åµ£ĆĶ┐æÕćĀõĖ¬µ£łńÜäńāŁµĢ░µŹ«µæäÕÅ¢Ķć│µĢ░µŹ«õ╗ōÕ║ōõĖŁŃĆé

┬ĘÕżäńÉåķÖäÕŖĀÕŁśÕé©ÕåģńÜäńāŁµĢ░µŹ«õĖĵĢ░µŹ«µ╣¢õĖŁńÜäÕÄåÕÅ▓µĢ░µŹ«’╝īńö▒µŁżńö¤µłÉõĖ░Õ»īµĢ░µŹ«ķøå’╝īÕģ©ń©ŗµŚĀķ£Ćµē¦ĶĪīõ╗╗õĮĢµĢ░µŹ«ń¦╗ÕŖ©µōŹõĮ£ŃĆé

┬ĘÕ░åõĖ░Õ»īµĢ░µŹ«ķøåµÅÆÕģźĶć│ķÖäÕŖĀÕŁśÕé©õĖŁńÜäĶĪ©Õåģ’╝īµł¢ĶĆģńø┤µÄźµÅÆÕģźńö▒µĢ░µŹ«µ╣¢µēśń«ĪńÜäÕż¢ķā©ĶĪ©õĖŁŃĆé

┬ĘĶĮ╗µØŠÕ░åÕż¦ķćÅÕåĘķŚ©ÕÄåÕÅ▓µĢ░µŹ«ńö▒µĢ░µŹ«õ╗ōÕ║ōĶĮ¼ń¦╗Ķć│µłÉµ£¼µø┤õĮÄÕ╗ēńÜäµĢ░µŹ«µ╣¢ÕŁśÕé©Õåģ’╝īõĖöõ╗Źõ┐ØĶ»üÕ░åÕģČõĮ£õĖ║Amazon Redshiftµ¤źĶ»óńÜäõĖĆķā©Õłåõ╗źõŠøĶĮ╗µØŠĶÄĘÕÅ¢ŃĆé

Amazon RedshiftõĖŁńÜäķ½śÕ║”ń╗ōµ×äÕī¢µĢ░µŹ«ķĆÜÕĖĖĶ┤¤Ķ┤ŻõĖ║õ║żõ║ÆÕ╝ŵ¤źĶ»óÕÅŖķ½śÕ║”ÕÅŚõ┐ĪńÜäÕŹ│µŚČÕĢåÕŖĪµÖ║ĶāĮõ╗¬ĶĪ©µØ┐µÅÉõŠøµö»µīü’╝øĶĆīAmazon S3ÕåģńÜäń╗ōµ×äÕī¢ŃĆüķØ×ń╗ōµ×äÕī¢õĖÄÕŹŖń╗ōµ×äÕī¢µĢ░µŹ«’╝īÕłÖÕĖĖĶó½ńö©õ║Äķ®▒ÕŖ©µ£║ÕÖ©ÕŁ”õ╣ĀŃĆüµĢ░µŹ«ń¦æÕŁ”õĖÄÕż¦µĢ░µŹ«ÕżäńÉåńö©õŠŗŃĆé

AWS DMSõĖÄAmazon AppFlowĶāĮÕż¤Õ░åµĢ░µŹ«õ╗Äń╗ōµ×äÕī¢µØźµ║Éńø┤µÄźõ╝ĀķĆÆĶć│S3µĢ░µŹ«µ╣¢µł¢Amazon RedshiftµĢ░µŹ«õ╗ōÕ║ō’╝īÕģģÕłåµ╗ĪĶČ│ńö©õŠŗńÜäÕģĘõĮōķ£Ćµ▒éŃĆéÕ£©µæäÕÅ¢µĢ░µŹ«µ¢ćõ╗Čõ╣ŗÕÉÄ’╝īDataSyncõ╝ÜÕ░åµĢ░µŹ«ÕŁśÕé©Ķć│Amazon S3ŃĆéÕżäńÉåÕ▒éń╗äõ╗ČÕÅ»ķĆÜĶ┐ćÕŹĢõĖĆń╗¤õĖƵğÕÅŻ’╝łõŠŗÕ”éAmazon Redshift SQL’╝ēĶ«┐ķŚ«ń╗¤õĖƵÖ║ĶāĮµ╣¢õ╗ōÕŁśÕé©Õ▒éÕåģńÜäµĢ░µŹ«’╝īÕ╣Čńö▒µÄźÕÅŻõĮ┐ńö©Redshift SpectrumÕ░åAmazon RedshiftķøåńŠżõĖŁÕŁśÕé©ńÜäµĢ░µŹ«õĖÄAmazon S3ńÜäµĢ░µŹ«ÕŖĀõ╗źÕÉłÕ╣ČŃĆé

Õ£©S3µĢ░µŹ«µ╣¢Õåģ’╝īń╗ōµ×äÕī¢õĖÄķØ×ń╗ōµ×äÕī¢µĢ░µŹ«ÕØćĶó½ÕŁśÕé©õĖ║S3Õ»╣Ķ▒ĪŃĆéµĢ░µŹ«µ╣¢ÕåģńÜäÕÉäS3Õ»╣Ķ▒Īõ╝ܵīēÕŁśÕ驵Īȵł¢ÕēŹń╝ĆÕÉŹń¦░Ķó½ÕłÆÕłåõĖ║ńÖ╗ķÖåÕī║ŃĆüÕĤզŗÕī║ŃĆüÕÅŚõ┐ĪÕī║ÕÅŖńŁ¢ÕłÆÕī║ńŁēÕćĀń¦Źń▒╗Õł½ŃĆéÕ»╣õ║ÄÕ░åµĢ░µŹ«ÕŁśÕé©Õ£©S3µĢ░µŹ«µ╣¢ÕåģńÜäń«Īķüō’╝īµĢ░µŹ«Õ░åõ╗ÄµØźµ║ÉÕżäĶó½ńø┤µÄźµæäÕÅ¢Ķć│ńÖ╗ķÖåÕī║ÕåģŃĆéµÄźõĖŗµØź’╝īÕżäńÉåÕ▒éÕ░åķ¬īĶ»üńÖ╗ķÖåÕī║µĢ░µŹ«Õ╣ČÕ░åń╗ōµ×£ÕŁśÕé©Õ£©ÕĤզŗÕī║Õåģµł¢µĘ╗ÕŖĀńøĖÕ║öÕēŹń╝Ćõ╗źõŠøµ░Ėõ╣ģÕŁśÕé©ŃĆéõ╣ŗÕÉÄ’╝īÕżäńÉåÕ▒éÕ»╣ÕĤզŗÕī║µĢ░µŹ«µē¦ĶĪīschemaŃĆüÕłåÕī║õ╗źÕÅŖÕģČõ╗¢ĶĮ¼µŹó’╝īńĪ«õ┐صĢ░µŹ«ĶŠŠÕł░õĖĆĶć┤ńŖȵĆü’╝īÕżäńÉåÕÉÄńÜäń╗ōµ×£Ķó½ń╗¤õĖĆÕŁśÕé©Õ£©ÕÅŚõ┐ĪÕī║ÕåģŃĆéµ£ĆÕÉÄõĖƵŁź’╝īÕżäńÉåÕ▒éÕ»╣ÕÅŚõ┐ĪÕī║µĢ░µŹ«ķøåĶ┐øĶĪīÕ╗║µ©Ī’╝īÕåŹÕ░åń╗ōµ×£õĖÄÕģČõ╗¢µĢ░µŹ«ķøåĶ┐øĶĪīÕÉłÕ╣Čõ╗źÕ«×µ¢ĮńŁ¢ÕłÆ’╝īµ£Ćń╗łń╗ōµ×£Ķó½ÕŁśÕé©Õ£©ńŁ¢ÕłÆÕ▒éÕåģŃĆéķĆÜÕĖĖ’╝īµØźĶć¬ńŁ¢ÕłÆÕ▒éńÜäµĢ░µŹ«ķøåõ╝ÜĶó½ķā©Õłåµł¢Õģ©ķā©ń║│ÕģźAmazon RedshiftµĢ░µŹ«õ╗ōÕ║ōõĖŁ’╝īõ╗źµö»µīüķéŻõ║øĶ”üµ▒éµ×üõĮÄĶ«┐ķŚ«Õ╗ČĶ┐¤ŃĆüµł¢ĶĆģķ£ĆĶ”üĶ┐ÉĶĪīķ½śÕżŹµØéÕ║”SQLµ¤źĶ»óńÜäńö©õŠŗŃĆé

ÕÉäõĖ¬Õī║ÕåģńÜäµĢ░µŹ«ķøå’╝īķĆÜÕĖĖõ╝ܵĀ╣µŹ«ńøĖÕ║öÕī║’╝łÕĤզŗŃĆüÕÅŚõ┐Īµł¢ńŁ¢ÕłÆÕī║’╝ēµČłĶ┤╣µ©ĪÕ╝ÅńÜäÕī╣ķģŹķö«Ķ┐øĶĪīÕłåÕī║ŃĆéÕÅéĶĆāµ×ȵ×äõĮ┐ńö©GZIPŃĆüBZIPõ╗źÕÅŖSnappyńŁēÕ╝Ƶ║Éń╝¢Ķ¦ŻńĀüÕÖ©Õ»╣µĢ░µŹ«ķøåµēĆÕ»╣Õ║öńÜäS3Õ»╣Ķ▒Īµē¦ĶĪīÕÄŗń╝®’╝īÕƤµŁżķÖŹõĮÄÕŁśÕ驵łÉµ£¼Õ╣Čń╝®ń¤ŁÕżäńÉåÕ▒éõĖĵȳĶ┤╣Õ▒éÕåģńÜäń╗äõ╗ČĶ»╗ÕÅ¢µŚČķŚ┤ŃĆéµĢ░µŹ«ķøåķĆÜÕĖĖõ╗źParquetÕÅŖORCńŁēÕ╝Ƶ║ÉÕłŚÕ╝ÅÕŁśÕ驵Ā╝Õ╝ÅÕŁśÕ£©’╝īõ╗źĶ┐øõĖƵŁźÕćÅÕ░æÕżäńÉåÕ▒éõĖĵȳĶ┤╣Õ▒éń╗äõ╗ȵ¤źĶ»óµ¤Éõ║øÕłŚÕŁÉķøåµŚČµēĆķ£ĆĶ»╗ÕÅ¢ńÜäµĢ░µŹ«ķćÅŃĆéAmazon S3µÅÉõŠøõĖĆń│╗ÕłŚķÆłÕ»╣õĖŹÕÉīńö©õŠŗĶ«ŠĶ«ĪńÜäÕŁśÕé©ń▒╗ŃĆéÕģČõĖŁAmazon S3µÖ║ĶāĮÕłåÕ▒éÕŁśÕé©ń▒╗õĖōķŚ©ńö©õ║ÄÕ£©õĖŹÕĮ▒ÕōŹµĆ¦ĶāĮµł¢Ķ┐ÉĶÉźÕ╝ĆķöĆńÜäÕēŹµÅÉõĖŗ’╝īĶć¬ÕŖ©Õ░åµĢ░µŹ«ĶĮ¼ń¦╗Ķć│µ£ĆÕģʵłÉµ£¼µĢłńøŖńÜäĶ«┐ķŚ«Õ▒éÕåģŃĆé

Amazon RedshiftµÅÉõŠøPBń║¦µĢ░µŹ«õ╗ōÕ║ōÕŁśÕé©Õ«╣ķćÅ’╝īńö©õ║ÄÕŁśÕ驵īēń╗┤Õ║”µł¢ķØ×Ķ¦äĶīāÕī¢schemaÕ╗║µ©ĪńÜäķ½śÕ║”ń╗ōµ×äÕī¢µĢ░µŹ«ŃĆéÕ£©Amazon RedshiftõĖŖ’╝īµĢ░µŹ«Õ░åõ╗źķ½śÕÄŗń╝®µ»öÕłŚÕ╝ŵĀ╝Õ╝ÅÕŁśÕé©’╝īÕ╣ČÕłåÕĖāÕ╝ÅÕŁśÕé©Õ£©ķ½śµĆ¦ĶāĮĶŖéńé╣ķøåńŠżõĖŖŃĆéÕÉäõĖ¬ĶŖéńé╣µ£ĆÕżÜµÅÉõŠø64 TBķ½śµĆ¦ĶāĮµēśń«ĪÕŁśÕé©Õ«╣ķćÅŃĆéAmazon Redshiftõ╝ÜÕ╝║ÕłČµē¦ĶĪīschema-on-writeŃĆüACIDõ║ŗÕŖĪõĖÄÕĘźõĮ£Ķ┤¤ĶĮĮķÜöń”╗ńŁēµ£║ÕłČ’╝īÕƤµŁżõ┐ØķÜ£µĢ░µŹ«ńÜäķ½śĶ┤©ķćÅõĖÄõĖĆĶć┤µĆ¦ŃĆéńö©µłĘÕż¦ÕżÜÕ£©Amazon RedshiftõĖŖÕŁśÕé©ķ½śõĖĆĶć┤µĆ¦ŃĆüń╗¤õĖĆŃĆüÕÅ»õ┐ĪõĖöÕÅŚµÄ¦ńÜäń╗ōµ×äÕī¢µĢ░µŹ«ķøå’╝īÕƤµŁżµ╗ĪĶČ│ķ½śÕÉ×ÕÉÉķćÅŃĆüõĮÄÕ╗ČĶ┐¤õĖÄķ½śÕ╣ČÕÅæµĆ¦ńö©õŠŗŃĆéÕĮōńäČ’╝īµé©õ╣¤ÕÅ»õ╗źõĮ┐ńö©Amazon RedshiftõĖŁÕó×ķćÅÕ╝ÅÕłĘµ¢░ńÜäńē®Õī¢Ķ¦åÕøŠ’╝īõ╗źµśŠĶæŚµÅÉķ½śÕĢåÕŖĪµÖ║ĶāĮõ╗¬ĶĪ©µØ┐õĖŁÕżŹµØ鵤źĶ»óńÜäµĆ¦ĶāĮõĖÄÕÉ×ÕÉÉķćÅŃĆé

Õ£©ķĆÜĶ┐ćÕÉäń¦ŹµØźµ║ÉĶÄĘÕÅ¢µĢ░µŹ«Õ╣ȵ×äÕ╗║µÖ║ĶāĮµ╣¢õ╗ōµŚČ’╝īµłæõ╗¼õĖĆĶł¼ÕÅ»õ╗źńø┤µÄźÕ£©µĢ┤õĖ¬µĢ░µŹ«µ╣¢ÕÅŖµĢ░µŹ«õ╗ōÕ║ōõĖŁµēśń«ĪµĢ░ńÖŠńöÜĶć│µĢ░ÕŹāõĖ¬µĢ░µŹ«ķøåŃĆéõĖŁÕż«µĢ░µŹ«ńø«ÕĮĢÕ░åń╗¤õĖĆõĖ║µÖ║ĶāĮµ╣¢õ╗ōÕŁśÕé©’╝łµĢ░µŹ«õ╗ōÕ║ōõĖĵĢ░µŹ«µ╣¢’╝ēÕåģńÜäÕģ©ķā©µĢ░µŹ«ķøåµÅÉõŠøÕģāµĢ░µŹ«’╝īĶ┐ÖÕ░åÕż¦Õż¦ķÖŹõĮĵɣń┤óķÜŠÕ║”ŃĆüõ┐ØĶ»üµÖ║ĶāĮµ╣¢õ╗ōĶāĮÕż¤Õ¦ŗń╗łõ┐صīüĶē»ÕźĮńÜäµĢ░µŹ«ÕÅæńÄ░ĶāĮÕŖøŃĆ鵣żÕż¢’╝īĶ┐Öń¦ŹÕ░åÕģāµĢ░µŹ«ńö▒µĢ░µŹ«µ╣¢µēśń«ĪµĢ░µŹ«Õłåń”╗Ķć│ń╗¤õĖĆõĖŁÕż«schemańÜäÕżäńÉåµ¢╣Õ╝Å’╝īĶ┐śÕÅ»ÕĖ«ÕŖ®ÕżäńÉåÕ▒é/µČłĶ┤╣Õ▒éń╗äõ╗ČÕÅŖRedshift SpectrumĶĮ╗µØŠÕ«×ńÄ░schema-on-readŃĆé

Õ£©µ£¼µ¢ćńÜäµÖ║ĶāĮµ╣¢õ╗ōÕÅéĶĆāµ×ȵ×äõĖŁ’╝īLake FormationµÅÉõŠøńÜäõĖŁÕż«ńø«ÕĮĢĶ┤¤Ķ┤ŻÕŁśÕ驵Ö║ĶāĮµ╣¢õ╗ōõĖŁµēśń«ĪńÜäÕģ©ķā©µĢ░µŹ«ķøåńÜäÕģāµĢ░µŹ«’╝łµŚĀĶ«║µĢ░µŹ«ķøåÕ«×ķÖģÕŁśÕé©Õ£©Amazon S3Ķ┐śµś»Amazon RedshiftÕåģ’╝ēŃĆéńö©µłĘÕÅ»õ╗źÕ░åÕģ©ķā©µĢ░µŹ«ķøåńÜäµŖƵ£»ÕģāµĢ░µŹ«’╝łõŠŗÕ”éńēłµ£¼Õī¢ĶĪ©schemaŃĆüÕłåÕī║õ┐Īµü»ŃĆüńē®ńÉåµĢ░µŹ«õĮŹńĮ«õ╗źÕÅŖµø┤µ¢░µŚČķŚ┤µł│ńŁē’╝ēõĖÄõĖÜÕŖĪÕ▒׵Ʀ’╝łõŠŗÕ”éµĢ░µŹ«µēƵ£ēĶĆģŃĆüµĢ░µŹ«ń«ĪńÉåĶĆģŃĆüÕłŚõĖÜÕŖĪÕ«Üõ╣ēõ╗źÕÅŖÕłŚõ┐Īµü»µĢÅµä¤µĆ¦ńŁē’╝ēÕŁśÕé©Õ£©Lake FormationõĖŁŃĆé

Õż¦ķā©Õłåńö▒µĢ░µŹ«µ╣¢µēśń«ĪńÜäµĢ░µŹ«ķøå’╝īÕģČschemaķāĮÕ£©õĖŹµ¢ŁÕÅśÕī¢ŃĆüµĢ░µŹ«ÕłåÕī║õ╣¤Õ£©µīüń╗ŁÕó×ÕŖĀ’╝øĶĆīńö▒µĢ░µŹ«õ╗ōÕ║ōµēśń«ĪńÜäµĢ░µŹ«ķøåschemaÕłÖÕż¦ÕżÜõ╗źÕÅŚµÄ¦µ¢╣Õ╝ŵīüń╗Łµ╝öĶ┐øŃĆéAWS Glue crawlersĶāĮÕż¤ĶʤĶĖ¬µĢ░µŹ«µ╣¢µēśń«ĪµĢ░µŹ«ķøåõ╗źÕÅŖµĢ░µŹ«õ╗ōÕ║ōµĢ░µŹ«ķøåÕåģõĖŹµ¢ŁÕÅśÕī¢ńÜäµĢ░µŹ«schemaõĖĵ¢░Õó×ÕłåÕī║’╝īÕ╣ČÕ£©Lake Formationńø«ÕĮĢõĖŁõĖ║ńøĖÕ║öschemaµĘ╗ÕŖĀµ¢░ńÜäńēłµ£¼ŃĆ鵣żÕż¢’╝īLake FormationĶ┐śµÅÉõŠøAPI’╝īõŠøµé©õĮ┐ńö©Ķć¬Õ«Üõ╣ēĶäܵ£¼ÕÅŖń¼¼õĖēµ¢╣õ║¦ÕōüÕ«×ńÄ░ÕģāµĢ░µŹ«µ│©ÕåīõĖÄń«ĪńÉåŃĆé

Lake FormationõĖ║µĢ░µŹ«µ╣¢ń«ĪńÉåÕæśõ╗¼µÅÉõŠøõ║åõĖŁÕż«ń«ĪńÉåõĮŹńĮ«’╝īÕÅ»õ╗źõĖ║µĢ░µŹ«µ╣¢Õåģµēśń«ĪńÜäµĢ░µŹ«Õ║ōÕÆīĶĪ©Ķ«ŠńĮ«ń╗åÕī¢ńÜäĶĪ©ń║¦õĖÄÕłŚń║¦µØāķÖÉŃĆéÕ£©Ķ«ŠńĮ«Lake FormationµØāķÖÉõ╣ŗÕÉÄ’╝īńö©µłĘÕÆīÕÉäÕłåń╗äÕŬĶāĮõĮ┐ńö©ÕżÜõĖ¬ÕżäńÉåÕ▒éõĖĵȳĶ┤╣Õ▒éµ£ŹÕŖĪ’╝łõŠŗÕ”éAWS GlueŃĆüAmazon EMRŃĆüAmazon Athenaõ╗źÕÅŖRedshift SpectrumńŁē’╝ēĶ«┐ķŚ«µÄłµØāńÜäĶĪ©ÕÆīÕłŚŃĆé

µĢ░µŹ«ÕżäńÉåÕ▒é

µÖ║ĶāĮµ╣¢õ╗ōµ×ȵ×äõĖŁńÜäÕżäńÉåÕ▒éµÅÉõŠøÕżÜń¦ŹõĖōńö©ń╗äõ╗Č’╝īĶāĮÕż¤µö»µīüÕÉäń▒╗µĢ░µŹ«ÕżäńÉåńö©õŠŗŃĆéõĖ║õ║åÕī╣ķģŹµÖ║ĶāĮµ╣¢õ╗ōÕåģÕÉäµĢ░µŹ«ķøåńÜäńŗ¼ńē╣ń╗ōµ×ä’╝łÕ╣│ķØóĶĪ©ŃĆüÕżÜÕ▒鵳¢ĶĆģķØ×ń╗ōµ×äÕī¢’╝ēÕÅŖķƤÕ║”’╝łµē╣ķćŵł¢µĄüÕ╝Å’╝ē’╝īµé©ÕÅ»õ╗źńüĄµ┤╗ķĆēµŗ®õĖŹÕÉīńÜäõĖōńö©ÕżäńÉåń╗äõ╗ČŃĆéÕÉäõĖ¬ń╗äõ╗ČķāĮĶāĮÕż¤ķØóÕÉæAmazon S3õĖÄAmazon Redshift’╝łń╗¤ń¦░õĖ║µÖ║ĶāĮµ╣¢õ╗ōÕŁśÕé©’╝ēĶ»╗ÕåÖµĢ░µŹ«ŃĆé

µłæõ╗¼ÕÅ»õ╗źõĮ┐ńö©ÕżäńÉåÕ▒éń╗äõ╗ȵ×äÕ╗║µĢ░µŹ«ÕżäńÉåõĮ£õĖÜ’╝īĶ┐Öõ║øõĮ£õĖÜÕ░åõĮ┐ńö©õ╗źõĖŗµÄźÕÅŻÕ»╣ÕŁśÕé©Õ£©µĢ░µŹ«õ╗ōÕ║ōÕÅŖµĢ░µŹ«µ╣¢ÕåģńÜäµĢ░µŹ«Ķ┐øĶĪīĶ»╗ÕåÖ’╝Ü

Amazon Redshift SQL’╝łķģŹÕÉłRedshift Spectrum’╝ēŃĆé

Ķ┐ÉĶĪīÕ£©Amazon EMRõĖŖńÜäApache SparkõĮ£õĖÜŃĆé

Ķ┐ÉĶĪīÕ£©AWS GlueõĖŖńÜäApache SparkõĮ£õĖÜŃĆé

µé©ÕÅ»õ╗źõĮ┐ńö©AWS Glue crawlersµł¢Lake Formation API’╝īÕ░åń╗ōµ×£µĢ░µŹ«ķøåõĖŁńÜäÕģāµĢ░µŹ«µĘ╗ÕŖĀÕł░Lake FormationõĖŁÕż«ńø«ÕĮĢÕåģŃĆé

µé©õ╣¤ÕÅ»õ╗źõĮ┐ńö©õĖōńö©ń╗äõ╗ȵ×äÕ╗║Õć║ĶāĮÕż¤Õ«×ńÄ░õ╗źõĖŗÕŖ¤ĶāĮńÜäµĢ░µŹ«ĶĮ¼µŹóń«Īķüō’╝Ü

õĮ┐ńö©Amazon Redshift’╝łķģŹÕÉłRedshift Spectrum’╝ēŃĆüÕ¤║õ║ÄSQLńÜäELT

õĮ┐ńö©AWS Glueµł¢Amazon EMRÕ«×ńÄ░ńÜäÕż¦µĢ░µŹ«ÕżäńÉå

õĮ┐ńö©Amazon KinesisÕ«×ńÄ░ńÜäĶ┐æÕ«×µŚČµĄüÕ╝ŵĢ░µŹ«ÕżäńÉåŃĆé

ķĆÜĶ┐浥üÕ╝ŵŚĀµ£ŹÕŖĪÕÖ©ÕżäńÉåĶÄĘÕÅ¢Õ«×µŚČµ┤×Ķ¦ü

õĮ┐ńö©Apache FlinkõĖÄAmazon Kinesis Data AnalyticsÕ«×ńÄ░µĄüÕ╝ÅETL

õĮ┐ńö©Spark StreamingÕ£©AWS GlueõĖŖÕ«×ńÄ░Ķ┐æÕ«×µŚČµĄüÕ╝ŵĢ░µŹ«ÕżäńÉåŃĆé

õĮ┐ńö©Spark StreamingÕ£©Amazon EMRõĖŖÕ«×ńÄ░Ķ┐æÕ«×µŚČµĄüÕ╝ŵĢ░µŹ«ÕżäńÉåŃĆé

Õ¤║õ║ÄSQLńÜäELT

Ķ”üÕ£©µÖ║ĶāĮµ╣¢õ╗ōÕŁśÕé©Õ▒éõĖŁĶĮ¼µŹóń╗ōµ×äÕī¢µĢ░µŹ«’╝īµé©ÕÅ»õ╗źõĮ┐ńö©µé©µēĆń夵éēńÜäSQLĶ»Łõ╣ēµ×äÕ╗║ĶĄĘÕŖ¤ĶāĮÕ╝║Õż¦ńÜäELTń«ĪķüōŃĆéĶ┐Öõ║øELTń«ĪķüōÕ░åõĮ┐ńö©Amazon RedshiftõĖŁńÜäÕż¦Ķ¦äµ©ĪÕ╣ČÕÅæÕżäńÉå’╝łMPP’╝ēÕŖ¤ĶāĮõ╗źÕÅŖRedshift SpectrumÕŖ¤ĶāĮÕÉ»ÕŖ©µĢ░ÕŹāõĖ¬ń×¼µĆüĶŖéńé╣’╝īÕŹ│µŚČÕ░åÕżäńÉåÕ«╣ķćŵē®Õ▒ĢĶć│PBń║¦Õł½ŃĆéAmazon RedshiftõĖŖÕ¤║õ║ÄÕŁśÕé©Ķ┐ćń©ŗńÜäĶ┐Öń▒╗ELTń«ĪķüōĶāĮÕż¤Õ»╣õ╗źõĖŗÕ»╣Ķ▒ĪĶ┐øĶĪīĶĮ¼µŹó’╝Ü

┬Ęńö▒AWS DMSµł¢Amazon AppFlowńø┤µÄźõ╝ĀķĆÆĶć│Amazon Redshift stagingĶĪ©ńÜäÕ╣│ķØóń╗ōµ×äÕī¢µĢ░µŹ«

┬ĘõĮ┐ńö©Õ╝Ƶ║ɵ¢ćõ╗ȵĀ╝Õ╝Å’╝łõŠŗÕ”éJSONŃĆüAvroŃĆüParquetÕÅŖORCńŁē’╝ēµēśń«ĪÕ£©µĢ░µŹ«µ╣¢ÕåģńÜäµĢ░µŹ«

Õ£©µĢ░µŹ«õĖ░Õ»īµ£¤ķŚ┤’╝īĶ┐Öõ║øń«ĪķüōĶ┐śÕÅ»õ╗źõĮ┐ńö©SQLĶ»ŁÕÅźÕ░åÕåģķā©ń╗┤Õ║”ĶĪ©õĖÄS3µĢ░µŹ«µ╣¢Õåģµēśń«ĪńÜäÕż¦Õ×ŗõ║ŗÕ«×ĶĪ©’╝łõĮ┐ńö©Redshift SpectrumÕ▒é’╝ēĶ┐׵ğĶĄĘµØźŃĆéÕ£©µ£ĆÕÉÄõĖƵŁźõĖŁ’╝īµĢ░µŹ«ÕżäńÉåń«ĪķüōÕÅ»õ╗źÕ░åń╗ÅĶ┐ćńŁ¢ÕłÆŃĆüõĖ░Õ»īõĖÄÕ╗║µ©ĪńÜäµĢ░µŹ«µÅÆÕģźĶć│Amazon RedshiftÕåģķā©ĶĪ©µł¢ÕŁśÕé©Õ£©Amazon S3õĖŁńÜäÕż¢ķā©ĶĪ©ÕåģŃĆé

- Õ”éõĮĢÕ£©iPhoneõĖŖÕ┐½ķƤµēŠÕł░TikTokÕźĮÕÅŗ’╝¤Ķ┐ÖõĖżõĖ¬ń«ĆÕŹĢµ¢╣µ│ĢĶĮ╗µØŠµÉ×Õ«Ü’╝ü

- ÕøĮÕåģńö©µłĘÕ”éõĮĢõĖŗĶĮĮÕÆīõĮ┐ńö©TikTok’╝¤Ķŗ╣µ×£ÕÆīÕ«ēÕŹōĶ«ŠÕżćµ£ēõĖŹÕÉīĶ”üµ▒éÕÉŚ’╝¤

- õĖ╗Ķ┤”ÕÅĘõĖÄÕē»Ķ┤”ÕÅĘÕ”éõĮĢķģŹÕÉłńø┤µÆŁ’╝¤µÅŁń¦śÕż¦ÕÅĘń▓ēõĖØÕó×ķĢ┐ńÜäń¦śĶ»Ć’╝ü

- TikTokĶĮ»ĶĘ»ńö▒ń£¤ńÜäµ£ēÕ┐ģĶ”üÕÉŚ’╝¤Õ”éõĮĢĶ«®õĮĀńÜäńĮæķƤµ»öÕł½õ║║Õ┐½’╝¤

- ÕøĮÕåģµŚĀµ│ĢµŁŻÕĖĖõĮ┐ńö©TikTok’╝¤Ķ┐Öõ║øĶ«ŠńĮ«õĮĀń¤źķüōõ║åÕÉŚ’╝¤

- TikTokÕĖ”Ķ┤¦µØāķÖÉÕ”éõĮĢńö│Ķ»Ę’╝¤ÕĢåÕōüµ®▒ń¬ŚĶĮ╗µØŠÕÅśńÄ░’╝īõĮĀÕŁ”õ╝Üõ║åÕÉŚ’╝¤

- õĖ║õ╗Ćõ╣łÕøĮÕåģÕĮ▒Ķ¦åÕē¬ĶŠæõĖŹĶĄÜķÆ▒õ║å’╝¤TikTokĶāĮÕÉ”µłÉõĖ║õĮĀńÜäõĖŗõĖĆõĖ¬ĶĄÜķÆ▒Õł®ÕÖ©’╝¤

- TikTokń¤ŁĶ¦åķóæÕĖ”Ķ┤¦µĆĵĀʵēŹĶāĮµ£łĶĄÜ20õĖć’╝¤Õ░ÅÕøóķś¤Õ”éõĮĢÕ┐½ķĆ¤Õ«×ńÄ░ķ½śµöČńøŖ’╝¤