УЁЙУ«»С║Љ№╝џТхижЄЈТЋ░ТЇ«№╝їТъЂжђЪСйЊжфїРђћРђћTDSQL-AТаИт┐ЃТъХТъёУ»дУДБТЮЦС║є ?

ТгА

ТгА

6Тюѕ5ТЌЦ№╝їРђютЏйС║ДТЋ░ТЇ«т║ЊуАгТаИТіђТю»Т▓ЎжЙЎ-TDSQL-AТіђТю»ТЈГуДўРђЮтдѓу║дУђїУЄ│сђѓ5СйЇУЁЙУ«»С║ЉТіђТю»тцДтњќтѕєтѕФС╗јТЋ┤СйЊТіђТю»ТъХТъёсђЂтѕЌт╝ЈтГўтѓетЈіуЏИтЁ│ТЅДУАїС╝ўтїќсђЂжЏєуЙцТЋ░ТЇ«С║цС║њТђ╗у║┐сђЂFragmentТЅДУАїТАєТъХ/ТЪЦУ»бтѕєуЅЄуГќуЋЦ/тГљТЪЦУ»бТАєТъХС╗ЦтЈітљЉжЄЈтїќТЅДУАїт╝ЋТЊјуГЅтцџСИфТќ╣жЮбт»╣TDSQL-AУ┐ЏУАїС║єТи▒тЁЦУДБУ»╗сђѓС╗ЦСИІтИдТЮЦУЁЙУ«»С║ЉТЋ░ТЇ«т║ЊТіђТю»Тђ╗уЏЉТЮјУиЃТБ«УђЂтИѕуџётюеу║┐тѕєС║Фсђѓ

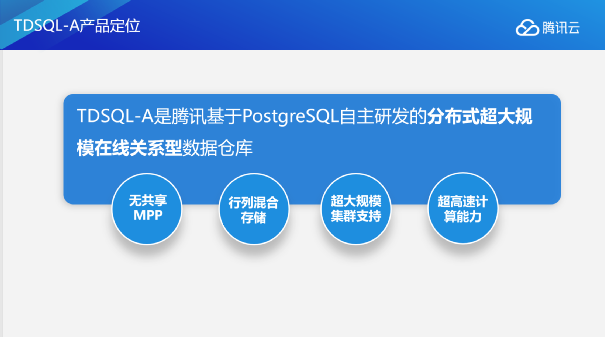

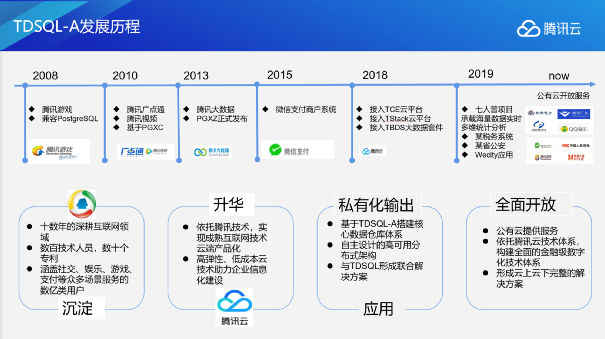

TDSQL-AС║ДтЊЂт«џСйЇ

TDSQL-AТў»УЁЙУ«»тЪ║С║јPostgreSQLУЄфСИ╗уаћтЈЉуџётѕєтИЃт╝ЈУХЁтцДУДёТеАтюеу║┐тЁ│у│╗тъІТЋ░ТЇ«С╗Њт║Њ№╝їСИџтіАтю║ТЎ»жњѕт»╣С║јтюеу║┐жФўТђДУЃйТЋ░ТЇ«тѕєТъљсђѓ

TDSQL-AТюЅтЏЏСИфСИ╗УдЂуЅ╣уѓ╣№╝џ

ТЌатЁ▒С║ФMPPУЃйт«ъуј░ТЌатЁ▒С║ФуџётГўтѓе№╝їУ┐ўтЈ»С╗Цт«ъуј░у║┐ТђДуџёТЅЕт▒Ћ№╝Џ

тюетГўтѓет▒ѓжЮб№╝їжђџУ┐ЄУЄфуаћтѕЌтГўтѓеТіђТю»№╝їУЃйтцЪтЂџтѕ░УАїтѕЌТиитљѕтГўтѓе№╝Џ

тюеТЋ░ТЇ«т║ЊУДёТеАТќ╣жЮб№╝їт«ъуј░С║єУХЁтцДУДёТеАжЏєуЙцуџёТћ»ТїЂ№╝Џ

СИ║С║єУ«Ет«бТѕиТюЅТЏ┤тЦйуџёСйЊжфї№╝їTDSQL-AУ┐ўТюЅУХЁжФўжђЪуџёУ«Ау«ЌУЃйтіЏ№╝їУЃйтцЪт┐ФжђЪтцёуљєСИџтіАС╗ЦтЈіУ»иТ▒ѓсђѓ

TDSQL-AтЈЉт▒ЋтјєуеІ

TDSQL-AТў»тюеУЁЙУ«»СИџтіАтЈЉт▒ЋУ┐ЄуеІСИГтГхтїќтЄ║ТЮЦуџёС║ДтЊЂсђѓТюђТЌЕуџёТЌХтђЎТѕЉС╗гТў»ућетЇЋТю║PGТЮЦтЂџСИђС║ЏтцДТЋ░ТЇ«т╣│тЈ░т░ЈУДёТеАуџёТЋ░ТЇ«тѕєТъљС╗ЦтЈіу╗ЊТъюу╝ЊтГўсђѓСйєжџЈуЮђУЁЙУ«»СИџтіАуџёТЅЕт╝а№╝їТѕЉС╗гтЈЉуј░тЇЋТю║уџёТЋ░ТЇ«т║Њти▓у╗ЈТЌаТ│ЋТћ»ТњЉуЏИтЁ│СИџтіАуџёТЋ░ТЇ«жЄЈтЈіУ»иТ▒ѓжЄЈ№╝їт░▒УљїућЪС║єт╝ђтЈЉтѕєтИЃт╝ЈТЋ░ТЇ«т║ЊуџёТЃ│Т│Ћсђѓтюе2013т╣┤ТѕЉС╗гтљ»тіеС║єуггСИђСИфуЅѕТюгуџёт╝ђтЈЉсђѓ

т╝ђтЈЉт«їТѕљтљјуџёTDSQL-PG(тјЪTBase V2№╝Ѕ№╝їТюђТЌЕућеТЮЦТћ»ТњЉтєЁжЃетЋєТѕиу│╗у╗ЪсђѓжџЈуЮђСИџтіАуџётЈЉт▒Ћ№╝їТѕЉС╗гтюеV2уџётЪ║уАђСИітбътіаС║єтѕЌтГўтѓетњїтѕєтИЃт╝Јт╝ѓТГЦТЅДУАїтЎесђЂтљЉжЄЈтїќуГЅOLAPжФўу║ДУЃйтіЏ№╝їтюеУъЇтЁЦС║єУЁЙУ«»С║ЉуџётЄаСИфСИ╗УдЂт╣│тЈ░тљј№╝їжђљТИљт»╣тцќТЈљСЙЏТюЇтіАсђѓTDSQL-AТюђУ┐ЉСИђТгАжЌфС║«С║«уЏИ№╝їТў»СИ║тј╗т╣┤уггСИЃТгАтЁетЏйС║║тЈБТЎ«ТЪЦТЈљСЙЏТіђТю»Тћ»ТњЉсђѓСйюСИ║тюеу║┐ТЋ░ТЇ«тѕєТъљт╝ЋТЊј№╝їTDSQL-AтЙѕтЦйтю░Тћ»ТњЉС║єтЏйт«ХС║║тЈБТЎ«ТЪЦуџёТЅДУАї№╝їУхитѕ░С║єтіатЦйуџёТЋѕТъюсђѓ

TDSQL-AТіђТю»ТъХТъё

тюет»╣TDSQL-AС║ДтЊЂУ┐ЏУАїуаћтЈЉтњїТъХТъёУ«ЙУ«АуџёТЌХтђЎ№╝їТѕЉС╗гСИ╗УдЂжЮбСИ┤тЏЏСИфТќ╣жЮбуџёТїЉТѕў№╝џ

СИђТў»жџЈуЮђ5GтњїloTТЌХС╗Буџётѕ░ТЮЦ№╝їТЋ░ТЇ«тЉѕуј░уѕєуѓИт╝ЈуџётбъжЋ┐сђѓтЇЋСИфТЋ░ТЇ«т║ЊжЏєуЙцжЄїжЮбжюђУдЂтцёуљєуџёТЋ░ТЇ«уџёт«╣жЄЈтЙѕт«╣ТўЊт░▒УЙЙтѕ░10PBу║ДтѕФуџётцДт░ЈсђѓУ┐Ўт»╣С╝ау╗ЪуџёТЋ░ТЇ«С╗Њт║ЊтЈіТЋ░ТЇ«т║ЊТЮЦУ»┤№╝їТў»СИђСИфжЮътИИТюЅТїЉТѕўуџёТЋ░ТЇ«УДёТеАсђѓ

С║їТў»жџЈуЮђТЋ░ТЇ«жЄЈуџётбътцД№╝їТѕЉС╗гжюђУдЂтцёуљєуџёТЋ░ТЇ«т║ЊСИџтіАС╗ЦтЈітљёуДЇу▒╗тъІуџёу╗ѕуФ»УХіТЮЦУХітцџ№╝їт»╣ТЋ░ТЇ«т║Њуџёт╣ХтЈЉУдЂТ▒ѓТ»ћС╣ІтЅЇТЏ┤жФўС║єсђѓТѕЉС╗гТюђтцџуџёТЌХтђЎућџУЄ│жюђУдЂтцёуљєТЋ░тЇЃСИфOLAPуџёт╣ХтЈЉсђѓ

СИЅТў»жџЈуЮђСИџтіАу│╗у╗ЪуџётЈЉт▒Ћ№╝їТЪЦУ»бС╝џтЈўтЙЌт╝ѓтИИтцЇТЮѓ№╝їжюђУдЂТХЅтЈітѕ░У┐ЉтЇЂт╝атцДУАеуџёТЋ░ТЇ«тЁ│УЂћ№╝їУ┐Ўт»╣ТЋ░ТЇ«тГўтѓетњїТЋ░ТЇ«С╗Њт║ЊТЪЦУ»бС╝ўтїќжЃйТЈљтЄ║С║єтЙѕжФўуџёУдЂТ▒ѓсђѓ

тЏЏТў»т«бТѕитњїСИџтіАт»╣С║јт╗ХТЌХуџёУдЂТ▒ѓсђѓт«бТѕитИїТюЏТѕЉС╗гУХіТЮЦУХіт┐Фтю░Тііу╗ЊТъютцёуљєт«їТѕљ№╝їУ┐ЎТаиТЅЇУЃйТЏ┤тЦйтю░тј╗т«ъуј░УЄфти▒уџётЋєСИџС╗итђ╝тњїСИџтіАуЏ«ТаЄсђѓ

TDSQL-AС║ДтЊЂуџёТъХТъёУ«ЙУ«Ат░▒Тў»тЏ┤у╗ЋУ┐ЎтЏЏСИфжЌ«жбўуџёУДБтє│т▒Ћт╝ђуџёсђѓ

1.TDSQL-Aт«ъТЌХТЋ░ТЇ«С╗Њт║ЊтдѓСйЋУДБтє│Тћ»ТїЂУХЁтцДУДёТеАжЏєуЙц

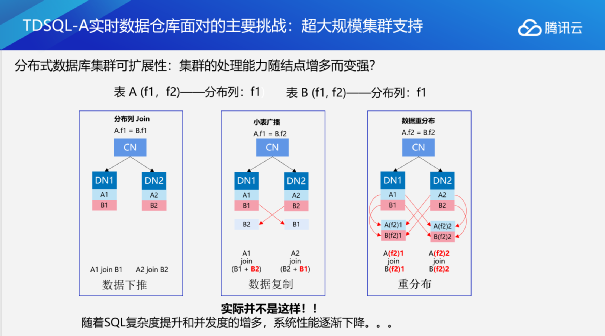

т»╣т«ъТЌХТЋ░ТЇ«С╗Њт║ЊТЮЦУ»┤№╝їуггСИђСИфУдЂУДБтє│уџёжЌ«жбўт░▒Тў»тдѓСйЋтј╗Тћ»ТїЂУХЁтцДУДёТеАуџёжЏєуЙцсђѓС╝ау╗ЪУ«цуЪЦУ«цСИ║№╝їтѕєтИЃт╝ЈТЋ░ТЇ«т║ЊжЏєуЙцуџётцёуљєУЃйтіЏС╝џжџЈу╗Њуѓ╣тбътцџУђїтЈўт╝║сђѓСйєт«ъжЎЁСИітЇ┤т╣ХжЮътдѓТГцсђѓ

СИІтЏЙт░▒Тў»ТѕЉС╗гУ┐ЏУАїтѕєтИЃт╝ЈТЪЦУ»буџёТЌХтђЎжюђУдЂт╗║уФІуџёуйЉу╗юУ┐ъТјЦ№╝їТѕќУђЁУ»┤ТѕЉС╗гжюђУдЂУ┐ЏУАїуйЉу╗южђџС┐Ауџёу«АжЂЊсђѓС╗јтЏЙСИГТѕЉС╗гтЈ»С╗ЦуюІтѕ░№╝їтюеСИцУАеУ┐ЏУАїJOINТЪЦУ»бТЌХ№╝їТѕЉС╗гт░ЉтѕЎжюђУдЂСИцСИфуйЉу╗юУ┐ъТјЦ№╝їтцџтѕЎжюђУдЂтЁФСИфуйЉу╗юУ┐ъТјЦсђѓжџЈуЮђSQLтцЇТЮѓт║дуџёТЈљтЇЄтњїт╣ХтЈЉуџётбътіа№╝їу│╗у╗ЪжюђУдЂт╗║уФІуџёуйЉу╗юТЋ░жЄЈтѕЎС╝џУХіТЮЦУХітцџ№╝їТЋ░ТЇ«С╗Њт║ЊуџётцёуљєУЃйтіЏСИЇСИђт«џС╝џТЈљтЇЄсђѓ

ућ▒ТГцТѕЉС╗гтЈ»С╗ЦтЙЌтЄ║СИђСИфу╗ЊУ«║№╝їтЇ│жЎљтѕХтѕєтИЃт╝ЈТЋ░ТЇ«т║ЊТЅЕт▒ЋТђДуџёТаИт┐ЃжЌ«жбўС╣ІСИђ№╝їт░▒Тў»ТюЇтіАтЎеУ┐ъТјЦТЋ░У┐ЄжФўсђѓжѓБTDSQL-AТў»тдѓСйЋУДБтє│У┐ЎСИфжЌ«жбўуџётЉб№╝Ъ

тЁеТќ░У«ЙУ«Ауџёт╝ѓТГЦТЅДУАїтЎеУДБУђдТјДтѕХтњїТЋ░ТЇ«С║цС║њ

ждќтЁѕтюеТЅДУАїжђ╗УЙЉТќ╣жЮб№╝їТѕЉС╗гУ«ЙУ«АС║єтЁеТќ░уџёТЅДУАїтЎе№╝їТЮЦУДБУђдSQLТЅДУАїуџёуџёТјДтѕХжђ╗УЙЉтњїТЅДУАїжђ╗УЙЉсђѓ

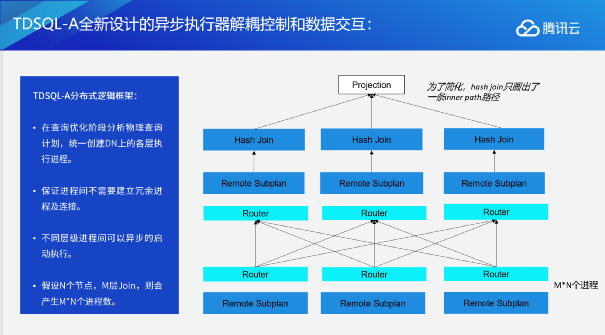

тюеТЪЦУ»бС╝ўтїќжўХТ«хТѕЉС╗гжђџУ┐ЄтѕєТъљуЅЕуљєТЪЦУ»бУ«Атѕњ№╝їт»╣ТЅДУАїУ«АтѕњУ┐ЏУАїтѕєуЅЄ№╝їућ▒CNтюетљёСИфУіѓуѓ╣тѕЏт╗║ТЅДУАїУ┐ЏуеІсђѓТ»ЈСИфУ┐ЏуеІУ┤ЪУ┤БТЅДУАїСИђСИфУ«АтѕњтѕєуЅЄ№╝їУ┐ЎС║ЏУ┐ЏуеІСИЇтЁ│Т│еуйЉу╗южђџС┐А№╝їуЏИС║њуІгуФІТЅДУАїсђѓ

тЂЄУ«ЙNСИфУіѓуѓ╣№╝їMт▒ѓjoin№╝їтѕЎС╝џС║ДућЪM*NСИфУ┐ЏуеІсђѓ

У┐ЎуДЇУ«ЙУ«АСИђТќ╣жЮбтѕєуд╗С║єSQLТЅДУАїуџёТјДтѕХжђ╗УЙЉтњїТЅДУАїжђ╗УЙЉ№╝ЏтЈдтцќСИђТќ╣жЮб№╝їС╣Ът░єуйЉу╗юУ┐ъТјЦС╗јтЁиСйЊТЅДУАїжђ╗УЙЉТійУ▒АС║єтЄ║ТЮЦ№╝їтЈўТѕљС║єСИђу╗ёТјЦтЈБ№╝їSQLТЅДУАїт╝ЋТЊјтЈфжюђУдЂтЁ│Т│еУЄфти▒уџёТЅДУАїжђ╗УЙЉ№╝їт»╣С║јт║Ћт▒ѓуџёжђџУ«»жђ╗УЙЉтѕЎСИЇућеСИЊжЌетј╗у╝ќтєЎС╗БуаЂсђѓУђїСИћ№╝їУ┐ЎС║ЏУ┐ЏуеІС╣ІжЌ┤уЏИС║њуІгуФІ№╝їТ▓АТюЅуЏИС║њуџёСЙЮУхќтЁ│у│╗№╝їТ▓АТюЅжћЂтњїУ┐ЏуеІтљїТГЦ№╝їТЅДУАїТЋѕујЄтцДтцДТЈљтЇЄсђѓ

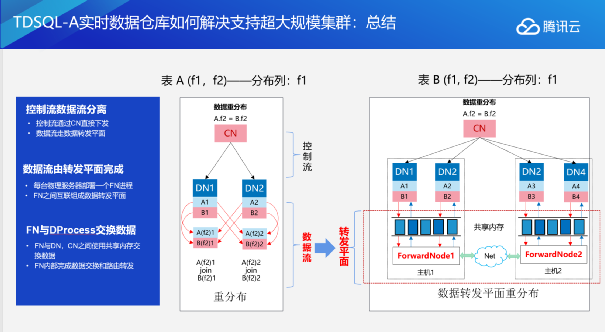

жЏєСИГТЋ░ТЇ«С║цС║њТђ╗у║┐УДБтє│жЏєуЙцуйЉу╗юуЊХжбѕ

тюежђџУ«»жђ╗УЙЉТќ╣жЮб№╝їТѕЉС╗гУ┐ЏСИђТГЦт╝ЋтЁЦForward Node№╝ѕFN№╝ЅТЮЦУ┐ЏУАїУіѓуѓ╣жЌ┤ТЋ░ТЇ«С║цС║њсђѓТ»ЈтЈ░уЅЕуљєТю║СИђСИфFNУіѓуѓ╣сђѓFNСИјCN/DNжђџУ┐ЄтЁ▒С║ФтєЁтГўУ┐ЏУАїТЋ░ТЇ«С║цС║њ№╝їТюгТю║ТЋ░ТЇ«С║цС║њУ┐ўтЈ»С╗ЦСИЇУх░уйЉу╗ют▒ѓ№╝їС╗јУђїТЈљСЙЏТЏ┤жФўуџёТђДУЃйсђѓтЂЄУ«ЙNСИфУіѓуѓ╣№╝їMт▒ѓJoin№╝їСИћСИЇу«АТЪЦУ»бтцџтцЇТЮѓ№╝їтЈфТюЅS*(N-1)СИфуйЉу╗юУ┐ъТјЦТЋ░сђѓУ┐Ўт»╣С║јТюЇтіАтЎеТЮЦУ»┤Тў»т╣ХСИЇу«ЌТў»СИђСИфтЙѕжФўуџёУ┤ЪУййсђѓ

ТѕЉС╗гТЮЦт░Ју╗ЊСИђСИІTDSQL-AТў»тдѓСйЋт«ъуј░УХЁтцДУДёТеАТЋ░ТЇ«жЏєуЙцТћ»ТїЂуџёсђѓ

ТѕЉС╗гт»╣ТЋ┤СИфТЋ░ТЇ«т║ЊуџёТЅДУАїжђ╗УЙЉУ┐ЏУАїС║єтѕєТхЂ№╝їТііТЋ░ТЇ«т║ЊтѕєСИ║С║єТјДтѕХТхЂтњїТЋ░ТЇ«ТхЂсђѓТЅђУ░ЊуџёТјДтѕХТхЂућ▒ТјДтѕХУіѓуѓ╣№╝їCNУіѓуѓ╣т«їТѕљ№╝їт«Ѓтј╗т«їТѕљТЅДУАїТю║ТъёуџёућЪТѕљ№╝їТЅДУАїТю║ТъёуџёСИІтЈЉС╗ЦтЈіУ┐љућеУхёТ║љуџётѕЮтДІтїќсђѓтюеТЅДУАїуџёУ┐ЄуеІСИГТјДтѕХт╣│жЮбт░▒СИЇС╝џтєЇтЈѓСИјТЅДУАїуџёУ┐ЄуеІ№╝їТЅДУАїУ┐ЄуеІт«їтЁеућ▒ТЅДУАїт╣│тЈ░ТЮЦт«їТѕљ№╝їТЅДУАїт╣│тЈ░СИ╗УдЂУ┤ЪУ┤БТЅДУАїУ┐ЄуеІСИГТЋ░ТЇ«уџёС║цС║њС╗ЦтЈіТЋ┤СИфТЅДУАїУ┐ЄуеІуџёУЙЙТѕљсђѓ

тюеТЅДУАїУ┐ЄуеІСИГ№╝їТЋ░ТЇ«ТхЂућ▒УйгтЈЉт╣│жЮбт«їТѕљ№╝їтЇ│FNУіѓуѓ╣сђѓТ»ЈСИфТюЇтіАтЎеСИіжЮбт░▒С╝џжЃеуй▓СИђСИфFNУ┐ЏуеІ№╝їСИЇтљїуџёуЅЕуљєТюЇтіАтЎеС╣ІжЌ┤уџёFNУ┐ЏуеІуЏИС║њУ┐ъТјЦтюеСИђУхиС╝џу╗ёТѕљСИђСИфУйгтЈЉт╣│жЮбсђѓFNУиЪТ»ЈтЈ░ТюЇтіАтЎеС╣ІжЌ┤жђџУ┐ЄСИІжЮбуџётЁ▒С║ФтєЁтГўтњїСИіжЮбуџёCNТѕќDNУ┐ЏУАїжђџС┐А№╝їFNтєЁжЃет«їТѕљТЋ░ТЇ«уџёС║цТЇбтњїУи»ућ▒УйгтЈЉсђѓ

2.TDSQL-AУЄфуаћУАїтѕЌТиитљѕтГўтѓеУЃйтіЏТЈљтЇЄOLAPТЋѕујЄ

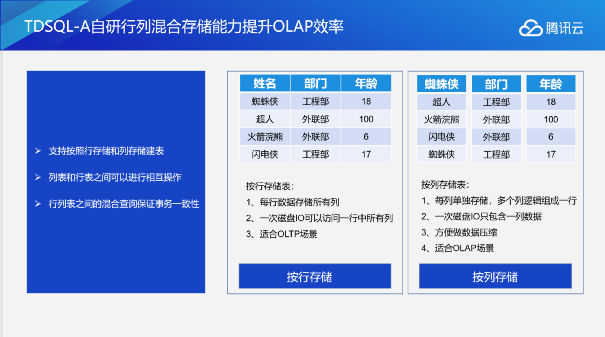

СИІжЮбС╗Іу╗ЇTDSQL-AтЁеУЄфуаћуџёУАїтѕЌТиитљѕуџётГўтѓеУЃйтіЏсђѓТЋ░ТЇ«т║ЊуџётГўтѓеТюЅСИцуДЇТќ╣т╝Ј№╝їСИђСИфТў»ТїЅУАїтГўтѓесђЂСИђСИфТў»ТїЅтѕЌтГўтѓе№╝џ

ТїЅУАїтГўтѓеУАе№╝џТ»ЈУАїТЋ░ТЇ«тГўтѓеТЅђТюЅтѕЌсђЂСИђТгАуБЂуЏўIOтЈ»С╗ЦУ«┐жЌ«СИђУАїСИГТЅђТюЅтѕЌсђЂжђѓтљѕOLTPтю║ТЎ»сђѓ

ТїЅтѕЌтГўтѓеУАе№╝џТ»ЈтѕЌтЇЋуІгтГўтѓе№╝їтцџСИфтѕЌжђ╗УЙЉу╗ёТѕљСИђУАї№╝ЏСИђТгАуБЂуЏўIOтЈфтїЁтљФСИђтѕЌТЋ░ТЇ«№╝ЏТќ╣СЙ┐тЂџТЋ░ТЇ«тјІу╝Е№╝ЏжђѓтљѕOLAPтю║ТЎ»сђѓ

TDSQL-AТћ»ТїЂТїЅтѕЌтГўтѓетњїТїЅУАїтГўтѓеСИцуДЇТќ╣т╝ЈТЮЦт╗║УАе№╝їтљїТЌХтюетѕЌУАетњїУАїУАеС╣ІжЌ┤№╝їућеТѕиСИЇућеТёЪуЪЦтѕ░СИІт▒ѓуџёУАеТў»жђџУ┐ЄУАїУАеУ┐ўТў»тѕЌУАеТЮЦт╗║№╝їУАїУАетњїтѕЌУАеС╣ІжЌ┤тЈ»С╗ЦУ┐ЏУАїТЌау╝ЮуџёС║њТЊЇСйюРђћРђћтїЁТІгуЏИС║њтЁ│УЂћсђЂуЏИС║њС║цТЇбТЋ░ТЇ«№╝їт«їтЁеСИЇжюђУдЂТёЪуЪЦтѕ░т║ЋСИІуџётГўтѓежђ╗УЙЉсђѓ

жЎцС║єТЊЇСйюуџёСЙ┐тѕЕТђДС╣Ітцќ№╝їУАїУАетњїтѕЌУАеС╣ІжЌ┤ТиитљѕТЪЦУ»бУ┐ўУЃйС┐ЮТїЂт«їТЋ┤уџёС║ІтіАСИђУЄ┤ТђД№╝їС╣Ът░▒Тў»У»┤тюеТЪЦУ»бУ┐љУАїуџётљїТЌХ№╝їТЋ┤СИфС║ІтіА№╝ѕACID№╝ЅуџёУЃйтіЏС╣ЪтЙЌтѕ░т«їТЋ┤уџёС┐ЮУ»Ђсђѓ

3.TDSQL-AтѕЌтГўтѓетјІу╝ЕУЃйтіЏжЎЇСйјСИџтіАТѕљТюг

СйюСИ║OLAPтю║ТЎ»СИІуџёС║ДтЊЂТЮЦУ»┤№╝їтјІу╝ЕТў»СИђжА╣жЮътИИжЄЇУдЂуџёУЃйтіЏ№╝їУ┐ЎжЄїС╗Іу╗ЇTDSQL-AуџётѕЌтГўтѓетјІу╝ЕУЃйтіЏсђѓ

уЏ«тЅЇТѕЉС╗гТћ»ТїЂСИцуДЇтјІу╝ЕТќ╣т╝Ј№╝џ

СИђТў»Уй╗жЄЈу║ДтјІу╝ЕсђѓУ┐ЎТў»УЃйтцЪТёЪуЪЦтѕ░ТЋ░ТЇ«тєЁт«╣уџёСИђуДЇтјІу╝ЕТќ╣т╝Јсђѓт«ЃтЈ»С╗Цжњѕт»╣ућеТѕиТЋ░ТЇ«уџёуЅ╣уѓ╣ТЈљСЙЏтљѕжђѓуџётјІу╝ЕТќ╣т╝ЈТЮЦжЎЇСйјућеТѕиуџёТѕљТюг№╝їтюеТюЅУДётЙІТЌХУЙЙтѕ░ТЋ░уЎЙтђЇуџётјІу╝ЕТ»ћсђѓТѕЉС╗гтЈ»С╗Цжњѕт»╣уЅ╣Т«іуџёТЋ░ТЇ«№╝їТ»ћтдѓжЄЇтцЇујЄТ»ћУЙЃжФўуџёТѕќУђЁТў»ТюЅУДётЙІсђЂТюЅжА║т║ЈуџёТЋ░ТЇ«У┐ЏУАїУй╗жЄЈу║ДтјІу╝Есђѓ

С║їТў»жђЈТўјтјІу╝ЕсђѓжђЈТўјтјІу╝ЕСИ╗УдЂТў»ућеzstdтњїgzipтјІу╝Еу«ЌТ│ЋТЮЦТЈљСЙЏтјІу╝ЕУЃйтіЏ№╝їтЈ»С╗ЦтИ«ућеТѕиУ┐ЏСИђТГЦтј╗тјІу╝ЕТѕљТюг№╝їТЈљтЇЄтцёуљєТЋѕујЄсђѓ

4.т╗ХУ┐ЪуЅЕтїќтјЪуљє

тюетѕєтИЃт╝Јтю║ТЎ»СИІ№╝їуЅ╣тѕФТў»УХЁтцДУДёТеАтѕєтИЃт╝Јтю║ТЎ»СИІ№╝їуйЉу╗юIOтњїCPUтЁХт«ъТў»жЮътИИжЄЇУдЂуџёУхёТ║љсђѓтдѓТъютюеУ«Ау«ЌТЌХ№╝їуйЉу╗юIOУЙЙтѕ░С║єуЊХжбѕ№╝їТѕќУђЁCPUУЙЙтѕ░С║єуЊХжбѕ№╝їжЃйС╝џС╗јТЋ┤СйЊСИітй▒тЊЇжЏєуЙцуџёТЅЕт▒ЋТђДтњїжЏєуЙцуџётцёуљєУЃйтіЏсђѓ

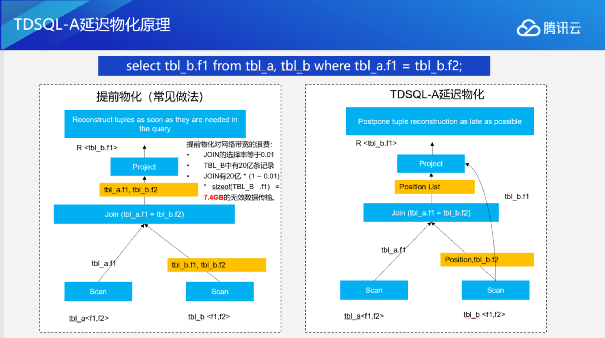

уЏ«тЅЇућеТЋ░ТЇ«т║ЊТѕќТЋ░ТЇ«С╗Њт║ЊУ┐ЏУАїТЪЦУ»бТЌХ№╝їтЙѕтцџСй┐ућеуџёжЃйТў»ТЈљтЅЇуЅЕтїќсђѓТЅђУ░ЊуџёТЈљтЅЇуЅЕтїќТў»уЏИт»╣С║јТЪЦУ»бТЮЦУ»┤уџёсђѓтЁХтюеТЋ░ТЇ«т║ЊжЄїжЮбС╝џтѕєУДБТѕљтЄаТГЦ№╝џуггСИђТГЦжюђУдЂС╗јСИІжЮбТюђт║Ћт▒ѓуџёУАежЄїжЮбТііТЋ░ТЇ«ТЪЦУ»бтЄ║ТЮЦ№╝їтєЇУ┐ЏУАїтЁ│УЂћ№╝їjoinт«їТѕљС╣ІтљјтєЇУ┐ЏУАїТіЋтй▒№╝їС╝ау╗ЎСИіт▒ѓУдЂСй┐ућеуџёСИђС║ЏтѕЌсђѓ

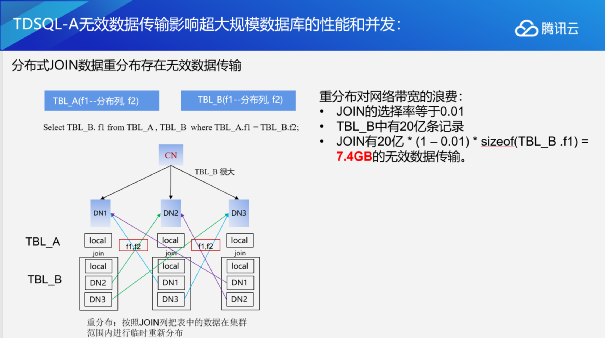

тЈ»С╗ЦуюІтѕ░№╝їтюеУ┐ЏУАїjoinТЌХТѕЉС╗гтЁХт«ътЈфтЁ│УЂћС║єУАеbуџёf2У┐ЎСИђтѕЌ№╝їСйєТў»ТіЋтй▒ТЌХтЇ┤ТіЋтй▒С║єУАеbуџёf1У┐ЎСИђтѕЌсђѓУ┐ЎТЌХт»╣С╣ІтЅЇуџёТЋ░ТЇ«т║ЊУ┐ЏУАїТЈљтЅЇуЅЕтїќТЌХ№╝їтюеС╝ажђњТЋ░ТЇ«у╗ЎjoinТЌХ№╝їТѕЉС╗гт░▒С╝џТііУАеbуџёf1тњїf2жЃйтљљтЄ║ТЮЦсђѓтЏаСИ║ТѕЉС╗гУ«Ау«ЌтЈЉуј░СИіт▒ѓprojectжюђУдЂf1У┐ЎСИђтѕЌ№╝їСйєТў»joinУ┐ЎжЄїжюђУдЂf2У┐ЎСИђтѕЌ№╝їТЅђС╗Цт«Ѓт░▒С╝џТііСИіт▒ѓжюђУдЂуџёТЅђТюЅтѕЌтЁежЃетюеУ┐ЎжЄїу«ЌтЄ║ТЮЦсђѓСйєт«ъжЎЁСИітдѓТъютюеУ┐ЎСИфтю░Тќ╣тЁ│УЂћТЌХУ┐ЄТ╗цуџёТ»ћСЙІтЙѕжФўуџёУ»Ю№╝їТ»ћтдѓУ»┤уј░тюеТюЅ1%уџёТ╗АУХ│ујЄ№╝їтЁХт«ътцДжЃетѕєуџёf1Тў»Т▓АТюЅТёЈС╣Ѕуџё№╝їтЏаСИ║Тюђу╗ѕтюеУ┐ЎжЄїжђџУ┐ЄjoinС╝џУбФТіЏт╝ЃТјЅсђѓтюеУХЁтцДУДёТеАуџётѕєтИЃт╝Јтю║ТЎ»СИІ№╝їтдѓТъюУАежЄїжЮбТюЅ20С║┐ТЮАУ«░тйЋ№╝їжђЅТІЕујЄТў»0.01уџёУ»Ю№╝їУ┐ЎСИфТЌХтђЎт░▒С╝џТюЅ7.4GBуџёТЌаТЋѕТЋ░ТЇ«С╝аУЙЊсђѓт»╣С║јтЇЂтѕєСЙЮУхќуйЉу╗юС╝аТњГуџётѕєтИЃт╝ЈТЋ░ТЇ«т║ЊТЮЦУ»┤№╝ї7.4СИфGBти▓у╗ЈТў»жЮътИИтЈ»УДѓуџёт╝ђжћђС║єсђѓ

тЏаТГцТѕЉС╗гт╝ЋтЁЦС║єтЈдтцќСИђуДЇуЅЕтїќу«ЌТ│Ћ№╝їтЇ│т╗ХУ┐ЪуЅЕтїќсђѓт╗ХУ┐ЪуЅЕтїќтЈ»С╗Цу«ђтЇЋуљєУДБСИ║СИЇУДЂтЁћтГљСИЇТњњж╣░сђѓТЅђУ░ЊуџёСИЇУДЂтЁћтГљСИЇТњњж╣░№╝їт░▒Тў»тюеТіЋтй▒уџёТЌХтђЎтЈфТІЅтј╗Т╗АУХ│ТЮАС╗ХуџёжѓБС║ЏТЋ░ТЇ«№╝їтЄЈт░ЉСИГжЌ┤У┐Ў7.4СИфGBуџёС╝аУЙЊсђѓУ┐Ўт░▒УдЂТѕЉС╗гтюеУ┐ЏУАїScanТЌХ№╝їтЈфуюІСИіт▒ѓjoinУіѓуѓ╣жюђУдЂуџёСИђС║ЏтѕЌ№╝їТііт«ЃС╝ажђњтѕ░СИіт▒ѓУіѓуѓ╣тј╗№╝їjoinт«їТѕљС╣ІтљјТііТ╗АУХ│ТЮАС╗ХуџёжѓБС║ЏтѕЌуџёСйЇуй«С┐АТЂ»С╝ажђњу╗ЎСИіт▒ѓуџёprojectУіѓуѓ╣сђѓТа╣ТЇ«ТѕЉС╗гуџёТхІУ»Ћ№╝їжџЈуЮђУАетЈўтЙЌУХіТЮЦУХітцЇТЮѓ№╝їжџЈуЮђТЪЦУ»бтЈўтЙЌУХіТЮЦУХітцЇТЮѓ№╝їУАетЈўтЙЌУХіТЮЦУХітцД№╝їТѕЉС╗гС╝ўтїќуџёТЋѕТъюС╣ЪУХіТЮЦУХіТўјТўЙсђѓ

5.TDSQL-AтЁет╣ХУАїУЃйтіЏсђЂтљЉжЄЈтїќУ«Ау«ЌУЃйтіЏ

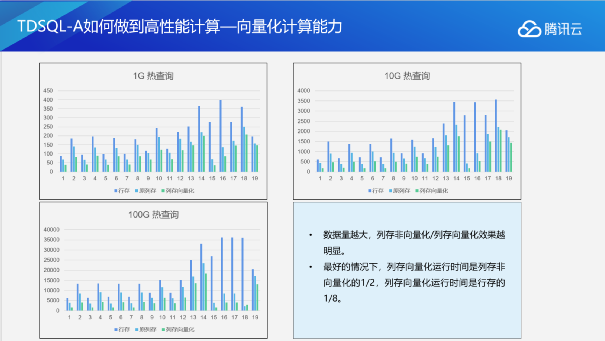

жЎцС║єСИіжЮбуџёт╗ХУ┐ЪуЅЕтїќтцќ№╝їТѕЉС╗гУ┐ўт╝ЋтЁЦС║єу│╗у╗ЪуџётЁет╣ХУАїУЃйтіЏсђѓтЁет╣ХУАїУЃйтіЏт»╣ТЋ░ТЇ«т║ЊуџёOLAPтю║ТЎ»ТЋ░ТЇ«т║ЊТЮЦУ«▓Тў»СИђСИфт┐Ёу╗ЈС╣ІУи»сђѓMPPТъХТъёУ«ЕТѕЉС╗гтЁитцЄС║єтцџУіѓуѓ╣т╣ХУАїуџёТъХТъёС╝ўті┐№╝їтљїТЌХТѕЉС╗гУ┐ўжђџУ┐ЄС╝ўтїќтЂџтѕ░С║єУіѓуѓ╣тєЁжЃеуџётцџУ┐ЏуеІУ┐ЏуеІжЌ┤уџёУ┐ЏУАї№╝їт╣ХтюетєЁжЃеСй┐ућеС║єCPUуџёуЅ╣Т«іТїЄС╗цтЂџтѕ░ТїЄС╗цу║Дт╣ХУАї№╝їтЏаТГцTDSQL-AтЈ»С╗ЦтЂџтѕ░СИЅу║Дт╣ХУАї№╝їСЙЮТгАТў»№╝џУіѓуѓ╣у║Дт╣ХУАї№╝їУ┐ЏуеІу║Дт╣ХУАїС╗ЦтЈіТїЄС╗цу║Дт╣ХУАїсђѓУ┐ЎуДЇтЁет╣ХУАїуџёУЃйтіЏУЃйтцЪУ┐ЏСИђТГЦТЈљтЇЄТѕЉС╗гТЋ┤СйЊуџётцёуљєТЋѕујЄсђѓ

тљЉжЄЈтїќУ«Ау«ЌУЃйтіЏтюеOLAPСИіС╣ЪТў»СИђСИфт┐ЁжА╗ТјбУ«еуџёУ»ЙжбўсђѓTDSQL-AС╣ЪУ┐ЏУАїС║єСИђС║ЏТќ░уџёт░ЮУ»Ћ№╝їт╣Хт«ъуј░С║єтљЉжЄЈтїќУ«Ау«ЌУЃйтіЏ№╝џТЋ░ТЇ«жЄЈУХітцД№╝їтѕЌтГўжЮътљЉжЄЈтїќтњїтѕЌтГўтљЉжЄЈтїќТЋѕТъюУХіТўјТўЙ№╝їтюеТюђтЦйуџёТЃЁтєхСИІ№╝їтѕЌтГўтљЉжЄЈтїќУ┐љУАїТЌХжЌ┤Тў»тѕЌТЮЉжЮътљЉжЄЈтїќуџё1/2№╝їтѕЌтГўтљЉжЄЈтїќУ┐љУАїТЌХжЌ┤Тў»УАїТЮЉуџё1/8сђѓтѕЌтГўтѓеуџётљЉжЄЈтїќТЅДУАїУЃйтцЪУЙЙтѕ░УАїтГўтѓеТЅДУАї1/8тидтЈ│сђѓтљЉжЄЈтїќУ«Ау«ЌУЃйтіЏт»╣ТЋ┤СИфOLAPТђДУЃйуџёТЈљтЇЄТў»жЮътИИТўјТўЙуџёсђѓ

6.TDSQL-Aуџётцџт╣│жЮбУЃйтіЏТЈљСЙЏСИђУЄ┤уџёУ»╗ТЅЕт▒ЋТђД

тюеТЋ┤СйЊТъХТъёСИі№╝їTDSQL-AС╣ЪТЈљСЙЏС║єТ»ћУЙЃтЦйуџёСИђУЄ┤ТђДуџёУ»╗ТЅЕт▒ЋУЃйтіЏсђѓ

СИђУЄ┤ТђДуџёУ»╗ТЅЕт▒ЋУЃйтіЏТў»УиЪжџЈСИџтіАтю║ТЎ»уџётѓгућЪуџёТіђТю»уЅ╣ТђДсђѓТюЅСИђС║Џт«бТѕитЈЇТўаУ┐ЄУ┐ЎуДЇуџёТЃЁтєх№╝їт░▒Тў»тюеТЋ░ТЇ«т║ЊCPU№╝їтєЁтГўти▓у╗ЈућеТ╗АуџёТЃЁтєхСИІ№╝їУ┐ўТюЅТЏ┤тцџуџёСИџтіАУ»иТ▒ѓУдЂтіаУ┐ЏТЮЦсђѓСИ║С║єТ╗АУХ│У┐ЎуДЇУ»╗уџёТЅЕт▒ЋТђДжюђУдЂ№╝їТѕЉС╗гт░▒уаћтЈЉтЄ║С║єУЃйтцЪТЈљСЙЏУ»╗тЈќУЃйтіЏуџётцџт╣│жЮбуЅ╣ТђД№╝їу«ђтЇЋуљєУДБт░▒Тў»тюеУ»╗тєЎт╣│жЮбуџётЪ║уАђСИі№╝їжђџУ┐ЄтєЁжЃетцЇтѕХуџёТќ╣т╝ЈТЮЦтѕЏт╗║тЄ║СИђСИфтЈфУ»╗т╣│жЮб№╝їтј╗тцёуљєтЈфУ»╗уџёУ»иТ▒ѓсђѓуЏИТ»ћС╣ІтЅЇТќ░т╗║ТЋ░ТЇ«т║ЊжЏєуЙцуџёТќ╣т╝Ј№╝їУ┐ЎуДЇтЂџТ│ЋтюежЎЇСйјС║єСИџтіАТѕљТюгтњїу│╗у╗ЪтцЇТЮѓт║дуџётљїТЌХ№╝їС╣ЪтИ«тіЕт«бТѕиУДБтє│С║єтЙѕтцџуј░т«ъуџёжЌ«жбўсђѓ

7.TDSQL-AТЋ┤СйЊТіђТю»ТъХТъёт░Ју╗Њ

TDSQL-AТЋ┤СйЊуџёТіђТю»ТъХТъётЈ»С╗ЦТђ╗у╗ЊТѕљтЁГуѓ╣№╝џ

жђџУ┐ЄжЏєСИГт╝ЈуџёуйЉу╗юТъХТъёсђЂуйЉу╗юУъЇтљѕжђџС┐АТіђТю»С╗ЦтЈітљјжЮбтюеТЅДУАїу║Дт▒ѓжЮбт╝ЋтЁЦуџёУЃйтіЏ№╝їтЈ»С╗ЦУ┐ЏСИђТГЦтј╗ТІЊт▒ЋтѕєтИЃт╝ЈMPPТЋ░ТЇ«С╗Њт║ЊуџётГўтѓеУДёТеАуџёСИіжЎљ№╝їУЙЙтѕ░ТЋ░тЇЃтЈ░уџёУДёТеА№╝Џ

жђџУ┐ЄтљЉжЄЈтїќТіђТю»№╝їт║Ћт▒ѓТЋ┤СИфТЅДУАїу║Дуџёжђ╗УЙЉС╝ўтїќ№╝їтЂџтѕ░ТъЂжђЪOLAPуџётЊЇт║ћ№╝Џ

тюетГўтѓет▒ѓжЮбжђџУ┐ЄтцџуДЇжФўТЋѕуџёТЋ░ТЇ«тјІу╝ЕТќ╣т╝Ј№╝їТЈљСЙЏТъЂжФўуџётјІу╝ЕТ»ћ№╝їтИ«тіЕСИџтіАтј╗УіѓуюЂу╗ЈУљЦТѕљТюг№╝Џ

тюеТјЦтЈБт▒ѓжЮбт«їТЋ┤тЁ╝т«╣С║єSQL2003№╝їтљїТЌХт»╣ORALEУ»ГТ│ЋтЁ╝т«╣ТђДУЙЙтѕ░95%№╝їтїЁТІгтГўтѓеУ┐ЄуеІсђЂУДдтЈЉтЎеуГЅСИђу│╗тѕЌтєЁт«╣№╝Џ

Тћ»ТїЂУАїтѕЌТиитљѕтГўтѓетЈіУАїтѕЌТиитљѕТЊЇСйюуџёУЃйтіЏ№╝Џ

тђЪтіЕуЅ╣ТюЅУЃйтіЏтј╗У«┐жЌ«тцќжЃеТЋ░ТЇ«Т║љ№╝їтїЁТІгтѕєтИЃт╝Јт»╣У▒АтГўтѓе№╝їHDFSтГўтѓеуГЅ№╝їУЃйтцЪт«ъуј░тГўтѓеСИјУ«Ау«Ќтѕєуд╗сђѓ

TDSQL-Aтљју╗ГУДётѕњ

TDSQL-Aуџётљју╗ГУДётѕњтѕєСИ║СИцжЃетѕє№╝џ

СИђТќ╣жЮбТў»жЎєу╗Гт░єуЏ«тЅЇтЪ║С║јPG10уџёуЅѕТюг№╝їmergeтѕ░PG11сђЂPG12сђЂPG13уГЅТЏ┤жФўуЅѕТюг№╝їТїЂу╗Гтю░УиЪУ┐ЏуцЙтї║уЅѕТюгСИ░т»їуџёуЅ╣ТђД№╝їТЮЦТЈљтЇЄућеТѕиуџёСйЊжфї№╝їСИ║т«бТѕитѕЏжђаТЏ┤тцџС╗итђ╝сђѓ

тЈдСИђТќ╣жЮб№╝їжџЈуЮђуАгС╗ХТіђТю»уџёСИЇТќГтЈЉт▒Ћ№╝їтїЁТІгGPUсђЂFGAС╗ЦтЈіAPEУ┐ЎС║ЏТќ░уАгС╗ХуџётЈЉт▒Ћ№╝їу╗ЎТѕЉС╗гтѕЏжђаС║єСИ║т«бТѕитѕЏжђаТЏ┤жФўС╗итђ╝тЈ»УЃйТђД№╝їTDSQL-AС╣ЪтИїТюЏжђџУ┐Єт╝ЋтЁЦТќ░уАгС╗Х№╝їТЮЦТЈљтЇЄС║ДтЊЂуФъС║ЅтіЏ№╝їСИ║т«бТѕиТЈљСЙЏТЏ┤тЦйуџёТюЇтіАсђѓ

- тдѓСйЋтюеiPhoneСИіт┐ФжђЪТЅЙтѕ░TikTokтЦйтЈІ№╝ЪУ┐ЎСИцСИфу«ђтЇЋТќ╣Т│ЋУй╗ТЮЙТљът«џ№╝Ђ

- тЏйтєЁућеТѕитдѓСйЋСИІУййтњїСй┐ућеTikTok№╝ЪУІ╣Тъютњїт«ЅтЇЊУ«ЙтцЄТюЅСИЇтљїУдЂТ▒ѓтљЌ№╝Ъ

- СИ╗У┤дтЈиСИјтЅ»У┤дтЈитдѓСйЋжЁЇтљѕуЏ┤ТњГ№╝ЪТЈГуДўтцДтЈиу▓ЅСИЮтбъжЋ┐уџёуДўУ»ђ№╝Ђ

- TikTokУй»Уи»ућ▒уюЪуџёТюЅт┐ЁУдЂтљЌ№╝ЪтдѓСйЋУ«ЕСйауџёуйЉжђЪТ»ћтѕФС║║т┐Ф№╝Ъ

- тЏйтєЁТЌаТ│ЋТГБтИИСй┐ућеTikTok№╝ЪУ┐ЎС║ЏУ«Йуй«СйауЪЦжЂЊС║єтљЌ№╝Ъ

- TikTokтИдУ┤ДТЮЃжЎљтдѓСйЋућ│У»и№╝ЪтЋєтЊЂТЕ▒уфЌУй╗ТЮЙтЈўуј░№╝їСйатГдС╝џС║єтљЌ№╝Ъ

- СИ║С╗ђС╣ѕтЏйтєЁтй▒УДєтЅфУЙЉСИЇУхџжњ▒С║є№╝ЪTikTokУЃйтљдТѕљСИ║СйауџёСИІСИђСИфУхџжњ▒тѕЕтЎе№╝Ъ

- TikTokуЪГУДєжбЉтИдУ┤ДТђјТаиТЅЇУЃйТюѕУхџ20СИЄ№╝Ът░ЈтЏбжўЪтдѓСйЋт┐ФжђЪт«ъуј░жФўТћХуЏі№╝Ъ