УЁЙУ«»С║ЉEMRтЪ║С║јYARNжњѕт»╣С║ЉтјЪућЪт«╣тЎетїќуџёС╝ўтїќСИјт«ъУих

ТгА

ТгА

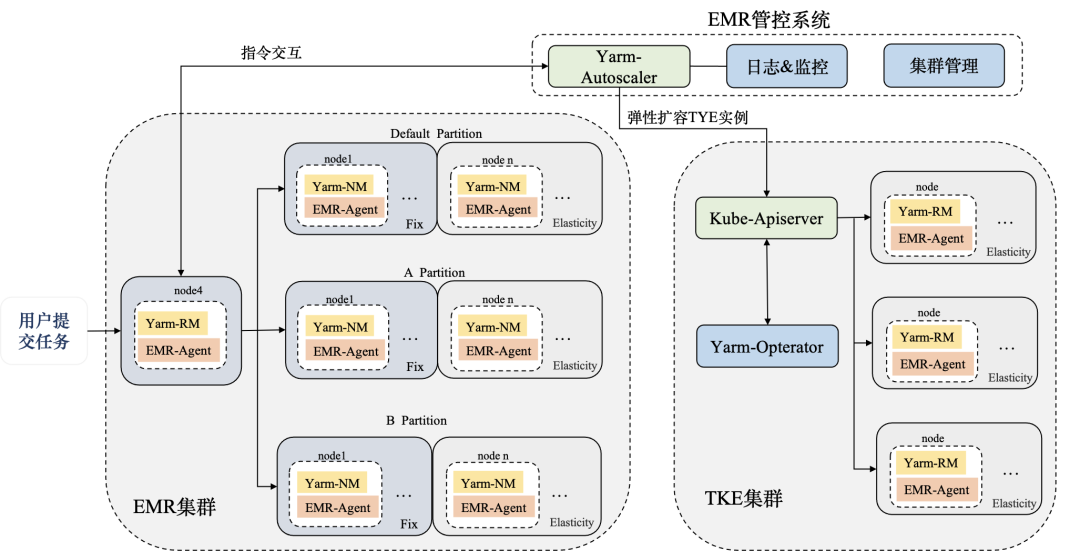

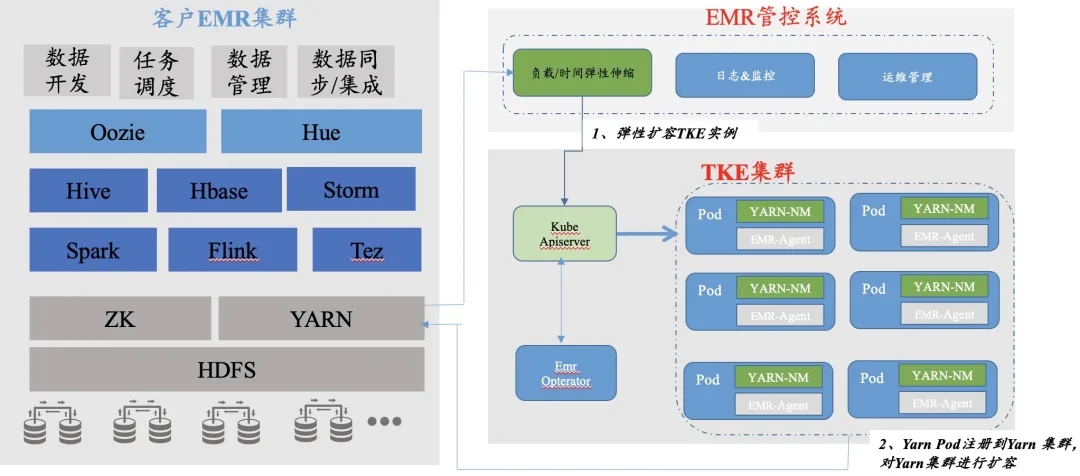

т»╝У»Г|С╝ау╗ЪHADOOPућЪТђЂу│╗у╗ЪСй┐ућеYARNу«Ауљє/У░Ѓт║дУ«Ау«ЌУхёТ║љ№╝їУ»Цу│╗у╗Ъ?УѕгтЁиТюЅТўјТўЙуџёУхёТ║љСй┐?тЉеТюЪсђѓт«ъТЌХУ«Ау«ЌжЏєуЙцУхёТ║љТХѕУђЌСИ╗УдЂтюе?тцЕ№╝їУђїТЋ░ТЇ«ТіЦУАетъІСИџтіАтѕЎт«ЅТјњтюеуд╗у║┐У«Ау«ЌжЏєуЙцСИГсђѓуд╗тюеу║┐СИџтіАтѕєт╝ђжЃеуй▓уџёждќУдЂжЌ«жбўт░▒Тў»УхёТ║љСй┐ућеујЄСйј№╝їТХѕУђЌТѕљТюг?сђѓжџЈуЮђСИџтіАуџётбъ?тњїуфЂтЈЉуџёТіЦУАеУ«Ау«ЌжюђТ▒ѓ№╝їСИ║С║єУДБтє│СИ║уд╗у║┐жЏєуЙцжбёуЋЎУхёТ║љ№╝їУЁЙУ«»С║ЉEMRтЏбжўЪтњїт«╣тЎетЏбжўЪУЂћтљѕТјетЄ║Hadoop Yarn on Kubernetes Pod№╝їС╗ЦТЈљ?т«╣тЎеУхёТ║љСй┐ућеујЄ№╝їжЎЇСйјУхёТ║љТѕљТюг№╝їт░єжЌ▓ТЌХт«╣тЎежЏєуЙцCPUСй┐?ујЄТЈљтЇЄТЋ░тђЇС╣ІтцџсђѓТюгТќЄСИ╗УдЂС╗Іу╗ЇHADOOPУхёТ║љУ░Ѓт║дтЎеYARNтюет«╣тЎеуј»тбЃСИГуџёС╝ўтїќСИјт«ъУихсђѓ

СИђсђЂHadoop Yarn on Kubernetes PodТиитљѕжЃеуй▓ТеАт╝Ј

Hadoop Yarn on Kubernetes PodТќ╣ТАѕТЈљСЙЏт╝╣ТђДТЅЕу╝Ет«╣тњїуд╗тюеу║┐ТиитљѕжЃеуй▓СИцжА╣тіЪУЃйсђѓт╝╣ТђДТЅЕу╝Ет«╣СИ╗УдЂУЂџуёдС║јтдѓСйЋтѕЕ?С║ЉтјЪућЪУхёТ║љ№╝їт┐ФжђЪТЅЕт«╣УхёТ║љС╗ЦУАЦтЁЁу«ЌтіЏсђѓуд╗тюеу║┐ТиитљѕжЃеуй▓ТеАт╝ЈуџёуЏ«уџёТў»СИ║С║єтЁЁтѕєСй┐ућетюеу║┐жЏєуЙцуџёуЕ║жЌ▓УхёТ║љ№╝їт░йтЈ»УЃйтЄЈт░ЉСИ║уд╗у║┐жЏєуЙцжбёуЋЎуЕ║жЌ▓УхёТ║љуџёжбЉТгАсђѓ

EMRт╝╣ТђДТЅЕу╝Ет«╣ТеАтЮЌ№╝ѕyarn-autoscaler№╝ЅТЈљСЙЏТїЅУ┤ЪУййтњїТїЅТЌХжЌ┤т╝╣ТђДС╝Иу╝ЕСИцуДЇТЅЕу╝Ет«╣Тќ╣т╝Јсђѓт»╣С║јТїЅУ┤ЪУййС╝Иу╝Е№╝їућеТѕитЈ»С╗Цт»╣СИЇтљїТїЄТаЄУ«Йуй«жўѕтђ╝ТЮЦУДдтЈЉТЅЕу╝Ет«╣№╝їТ»ћтдѓУ«Йуй«YarnжўЪтѕЌСИГavailablevcoreсђЂpending vcoreсђЂavailable memсђЂpending memсђѓС║дтЈ»С╗ЦСй┐ућеТЌХжЌ┤ТЅЕу╝ЕУДётѕЎ№╝їТїЅтцЕсђЂТїЅтЉесђЂТїЅТюѕуГЅУДётѕЎТїЄт«џУДдтЈЉсђѓ

тйЊт╝╣ТђДУДётѕЎУбФУДдтЈЉтљј№╝їуд╗тюеу║┐жЃеуй▓ТеАтЮЌУјитЈќтйЊтЅЇтюеу║┐TKEжЏєуЙцСИГтЈ»С╗ЦТЈљСЙЏуџёжЌ▓уй«у«ЌтіЏуџёУДёТа╝тЈіТЋ░жЄЈ№╝їУ░ЃућеKubernetes apiтѕЏт╗║т»╣т║ћТЋ░жЄЈуџёУхёТ║љ№╝їex-schedulerТЅЕт▒ЋУ░Ѓт║дтЎеуА«С┐ЮPodУбФтѕЏт╗║тюетЅЕСйЎУхёТ║љТЏ┤тцџуџёУіѓуѓ╣СИі№╝їУ»ЦPODУ┤ЪУ┤Бтљ»тіеYARNуџёТюЇтіАсђѓ

жђџУ┐ЄУ»ЦТќ╣ТАѕ№╝їYarnуџёNodeManagerТюЇтіАтЈ»С╗Цт┐ФжђЪжЃеуй▓тѕ░PODУіѓуѓ╣СИГсђѓСйєС╣ЪYarnтјЪућЪУ░Ѓт║дТ▓АТюЅУђЃУЎЉт╝ѓТъёУхёТ║љ№╝їућ▒ТГцт╝ЋтЈЉС║єСИцСИфжЌ«жбў№╝џ

1.AMуџёPODУбФжЕ▒жђљ№╝їт»╝УЄ┤APPтц▒У┤Ц

тюеnodeУіѓуѓ╣уџёУхёТ║љу┤Ду╝║уџёТЮАС╗ХСИІ№╝їkubeletСИ║С║єС┐ЮУ»ЂnodeУіѓуѓ╣уџёуе│т«џТђД№╝їтЏъУДдтЈЉСИ╗тіежЕ▒жђљpodуџёТю║тѕХсђѓтдѓТъюУ»ЦУіѓуѓ╣тГўтюеAMТюЇтіА№╝їтѕЎТЋ┤СИфApplicationт░▒УдЂУбФУДєСИ║тц▒У┤Ц№╝їResourceManagerТГцТЌХС╝џжЄЇТќ░тѕєжЁЇAMсђѓт»╣С║јУ«Ау«ЌжЄЈтЙѕтцДуџёС╗╗тіА№╝їApplicationжЄЇУиЉуџёС╗БС╗иСИЇтЈ»ТЅ┐тЈЌсђѓ

2.YarnтјЪућЪжЮъуІгтЇатѕєтї║УхёТ║љтЁ▒С║Фт▒ђжЎљТђД

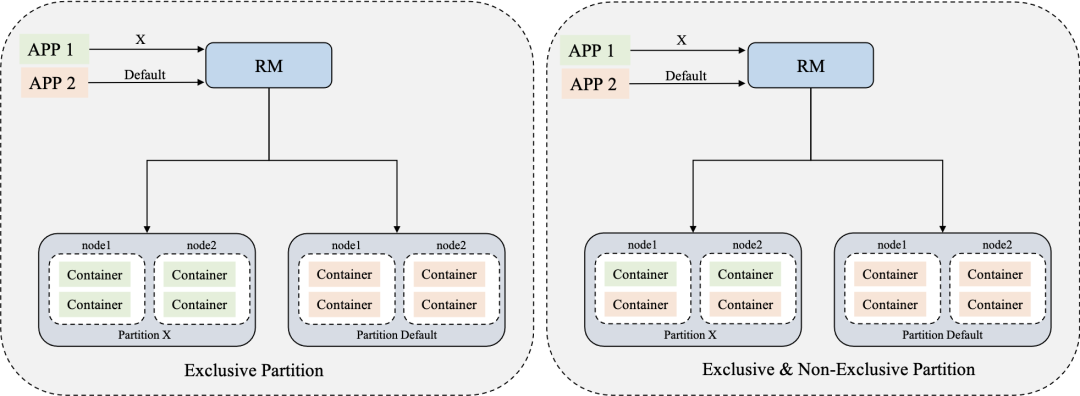

YarnуџёТаЄуГЙтѕєтї║уЅ╣ТђД?ТїЂуІгтЇатѕєтї║№╝ѕExclusive№╝Ѕ№╝їжЮъуІгтЇатѕєтї║№╝ѕNon-exclusive№╝Ѕсђѓ

┬иуІгтЇатѕєтї║№╝ѕExclusive№╝Ѕ№╝џСЙІтдѓТїЄт«џуІгтЇатѕєтї║x№╝їYarnуџёcontainerтЈфС╝џтѕєжЁЇтѕ░У»Цxтѕєтї║сђѓ

┬ижЮъуІгтЇатѕєтї║№╝ѕNon-exclusive№╝Ѕ№╝џСЙІтдѓжЮъуІгтЇатѕєтї║x№╝їxтѕєтї║уџёУхёТ║љтЈ»С╗ЦтЁ▒С║Фу╗Ўdefaultтѕєтї║сђѓ

тЈфТюЅтйЊТїЄт«џтѕєтї║defaultТЌХ№╝їdefaultСИіУ┐љ?уџёApplicationтЈ»С╗ЦСй┐?тѕєтї║xуџёУхёТ║љсђѓ

СйєТў»тюет«ъжЎЁСй┐?тю║ТЎ»СИГ№╝ї?ТѕиУдЂу╗ЎтљёСИфСИџтіАжЃежЌетѕєжЁЇтљёУЄфуџёуІгтЇатѕєтї║УхёТ║љ№╝їтљїТЌХС╝џтѕњтѕєтЄ║СЙЏтљёжЃежЌеСй┐ућеуџёdefaultтѕєтї║сђѓdefaultтѕєтї║УхёТ║љС╝џТ»ћУЙЃтЁЁУХ│№╝їСИџтіАжЃежЌетИїТюЏУЃйтцЪСй┐ућеУЄфти▒уџёуІгтЇатѕєтї║тњїтљїТЌХтЁЁтѕєтѕЕућеdefaultтѕєтї║УхёТ║љ№╝їуІгтЇатѕєтї║УхёТ║љтњїdefaultтѕєтї║жЃйСИЇтцЪућеуџёТЌХтђЎ№╝їТЅЇС╝џУДдтЈЉт╝╣ТђДТЅЕт«╣№╝їтЙђт▒ъС║јУЄфти▒уџёуІгтЇатѕєтї║СИГТЅЕт«╣УхёТ║љсђѓ

С║їсђЂт»╣YarnТћ╣жђатИдТЮЦуџёТїЉТѕў

т»╣СИіУ┐░featureуџёт╝ђтЈЉ№╝їжЎцС║єжюђТ▒ѓТіђТю»Тюг?уџёжџЙт║дсђѓУ┐ўжюђУдЂУђЃУЎЉтѕ░т░йтЈ»УЃйжЎЇСйјућеТѕитГўжЄЈжЏєуЙцуе│т«џТђДуџётй▒тЊЇ№╝їтЄЈт░ЉућеТѕиСИџтіАСЙДТћ╣жђаТѕљТюгсђѓ

┬ижЏєуЙцуе│т«џТђД№╝џHadoop YarnСйюСИ║тцДТЋ░ТЇ«у│╗у╗ЪСИГуџётЪ║уАђУ░Ѓт║ду╗ёС╗Х№╝їтдѓТъюТћ╣тіеУ┐Єтцџ№╝їт╝ЋтЈЉуџёТЋЁжџютЄаујЄт░▒С╝џтбътцДсђѓтљїТЌХт╝ЋтЁЦуџёfeature,т┐ЁуёХжюђУдЂтЇЄу║ДтГўжЄЈжЏєуЙцуџёHaoop YarnсђѓтЇЄу║ДТЊЇСйюУдЂтЂџтѕ░т»╣тГўжЄЈСИџтіАжЏєуЙцТЌаТёЪуЪЦ№╝їСИЇУЃйтй▒тЊЇтѕ░тйЊтцЕуџёСИџтіАсђѓ

┬иСИџтіАСЙДСй┐ућеТѕљТюг№╝џт╝ЋтЁЦуџёТќ░featureС╣Ът┐ЁжА╗угдтљѕтјЪ?yarnуџёСй┐ућеС╣аТЃ»№╝їТќ╣СЙ┐СИџтіАСЙДућеТѕиуљєУДБ№╝їтљїТЌХжЎЇСйјСИџтіАСЙДт»╣С╗БуаЂуџёТћ╣жђасђѓ

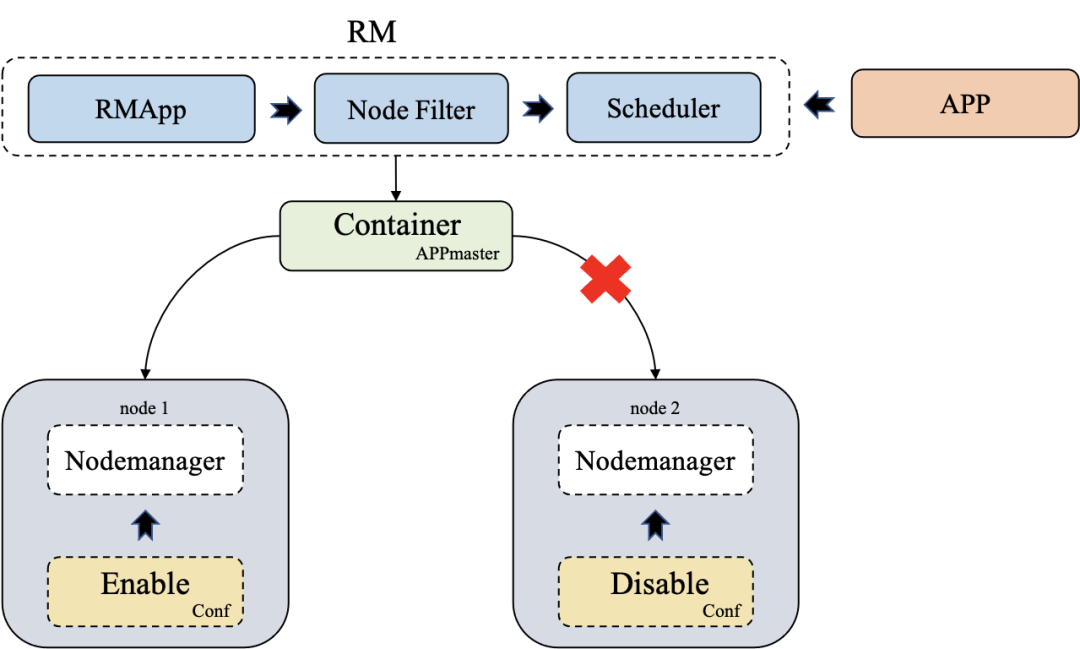

1.AMУЄфСИ╗жђЅТІЕтГўтѓеС╗ІУ┤е

уЏ«тЅЇYarnуџёуцЙтї║Т▓АТюЅУђЃУЎЉС║ЉСИіт╝ѓТъёУхёТ║љТиитљѕжЃеуй▓уџёуЅ╣уѓ╣сђѓтюеу║┐TKEжЏєуЙцСИГ№╝їтйЊУхёТ║љу┤Дт╝аТЌХС╝џт»╣т«╣тЎеУ┐ЏУАїжЕ▒жђљсђѓСИ║С║єжЂ┐тЁЇApplictionжЄЇТќ░У«Ау«Ќ№╝їТхфУ┤╣УхёТ║љуџёуј░У▒А№╝їт┐ЁжА╗ТЈљСЙЏAMтЈ»С╗ЦТїЄт«џУЃйтљдтѕєжЁЇтѕ░PODу▒╗тъІУхёТ║љсђѓ

УЄфСИ╗жђЅТІЕтГўтѓеС╗ІУ┤еСИГ№╝їСй┐ућежЁЇуй«тїќТаЄУ»є№╝їућ▒NodeManagerжђџУ┐ЄRPCСИіТіЦУЃйтљдт░єУхёТ║љТЈљСЙЏу╗ЎAMСй┐уће№╝їResourceManagerжђџУ┐ЄСИіТіЦС┐АТЂ»тє│т«џт░єApplicationуџёAMтѕєжЁЇтѕ░уе│т«џУхёТ║љС╗ІУ┤еСИГсђѓућ▒NodeManagerжђџУ┐ЄжЁЇуй«тїќСИіТіЦС┐АТЂ»уџётЦйтцёТў»ТўЙУђїТўЊУДЂуџё№╝џ

┬итј╗жЏєСИГтїќ№╝џтЄЈт░ЉResourceManagerтцёуљєжђ╗УЙЉсђѓтљдтѕЎ№╝їТЅЕт«╣УхёТ║љТЌХ№╝їУ┐ўжюђт░єУхёТ║љС┐АТЂ»жђџУ┐ЄRPC/жЁЇуй«ТхЂтЁЦтѕ░ResourceManagerСИГсђѓтдѓТЌат┐ЁУдЂ№╝їтІ┐тбът«ъСйЊ№╝їт»╣ResourceManagerуџёТћ╣жђат║ћУ»ЦУй╗жЄЈтїќсђѓ

┬ижЏєуЙцуе│т«џТђД№╝џтГўжЄЈСИџтіАжЏєуЙцт»╣YarnтЇЄу║Дтљј№╝їжюђУдЂжЄЇтљ»NodeManager,тЈфжюђУдЂжЄЇтљ»ResourceManagerсђѓYareуџёжФўтЈ»ућеуЅ╣ТђДтЈ»С┐ЮУ»ЂтЇЄу║ДУ┐ЄуеІт»╣СИџтіАТЌатй▒тЊЇсђѓТЌажюђжЄЇтљ»NodeManagerуџётјЪтЏаТў»№╝їNMж╗ўУ«цт░єТюгТю║УхёТ║љУДєСИ║тЈ»тѕєжЁЇсђѓ

┬иу«ђтЇЋТўЊуће№╝џућеТѕитЈ»С╗ЦжђџУ┐ЄжЁЇуй«?ућ▒тє│т«џС╗╗тіАУхёТ║љТІЦТюЅтѕєжЁЇAMуџёТЮЃтѕЕ№╝їСИЇтЇЋтЇЋт▒ђжЎљPODт«╣тЎеУхёТ║љсђѓ

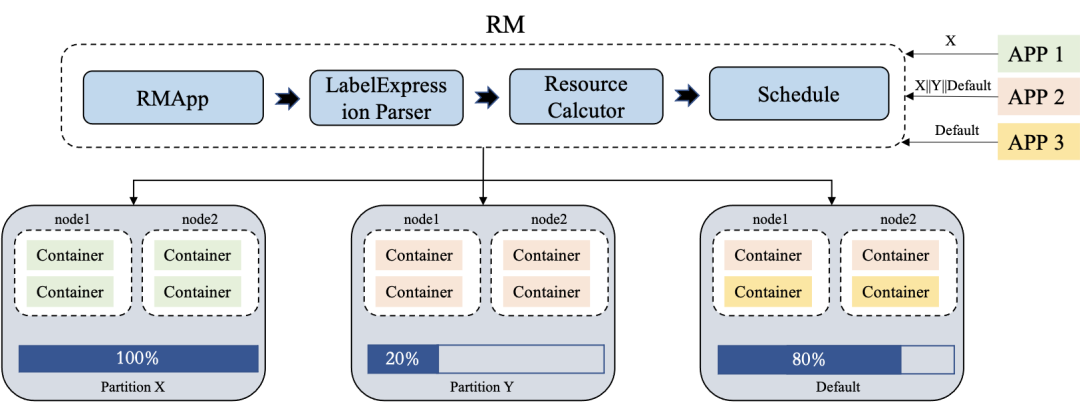

2.тцџТаЄуГЙтіеТђЂтѕєжЁЇУхёТ║љ

YarnуџётјЪућЪТаЄуГЙУ«ЙУ«АСИГ№╝їТЈљС║цС╗╗тіАТЌХуџёТаЄуГЙУАеУЙЙт╝ЈСИГтЈфУЃйтљФТюЅтЇЋСИфТаЄуГЙсђѓтдѓТъюСИ║С║єТЈљ?тѕЕућеујЄ№╝їтљїТЌХСй┐ућетцџСИфтѕєтї║УхёТ║љ№╝їт░▒т┐ЁжА╗т░єжЮъdefaultтѕєтї║У«Йуй«СИ║Non-exclusiveуЅ╣ТђДсђѓТаЄуГЙУАеУЙЙт╝Јт┐ЁжА╗УДБтє│тдѓСИІСИЅСИфжЌ«жбў№╝џ

┬иУхёТ║љжџћуд╗№╝џтѕєтї║AУ«Йуй«Non-exclusiveтљј№╝їУхёТ║љУбФтЁХС╗ќтѕєтї║СИіуџёAPPтЇаућетљј№╝їТЌаТ│ЋтЈіТЌХС║цТЇбу╗Ўтѕєтї║AуџёAppсђѓ

┬иУЄфућ▒тЁ▒С║ФУхёТ║љ№╝џтЈфТюЅdefaultтѕєтї║ТЅЇТюЅУхёТа╝ућ│У»иNon-exclusiveтѕєтї║УхёТ║љсђѓ

┬итіеТђЂжђЅТІЕтѕєтї║УхёТ║љ№╝џтцџтѕєтї║УхёТ║љтЁ▒С║ФТЌХ№╝їТЌаТ│ЋТа╣ТЇ«тѕєтї║тЅЕСйЎУхёТ║љтцДт░ЈжђЅТІЕтЈ»ућетї║№╝їтй▒тЊЇС╗╗тіАТЅДУАїТЋѕујЄсђѓ

УЁЙУ«»С║ЉEMRтЏбжўЪжђџУ┐ЄТћ»ТїЂТЅЕт▒ЋУАеУЙЙт╝ЈУ»ГТ│Ћ№╝їтбътіат»╣жђ╗УЙЉУ┐љу«ЌугдУАеУЙЙт╝ЈуџёТћ»ТїЂ№╝їСй┐AppтЈ»С╗Цућ│У»итцџСИфтѕєтї║УхёТ║љсђѓтљїТЌХт╝ђтЈЉУхёТ║љу╗ЪУ«АТеАтЮЌтіеТђЂу╗ЪУ«Атѕєтї║тЈ»ућеУхёТ║љ№╝їСИ║AppтѕєжЁЇТюђтљѕжђѓуџётѕєтї║сђѓ

СИЅсђЂт«ъТЊЇТ╝ћу╗Ѓ

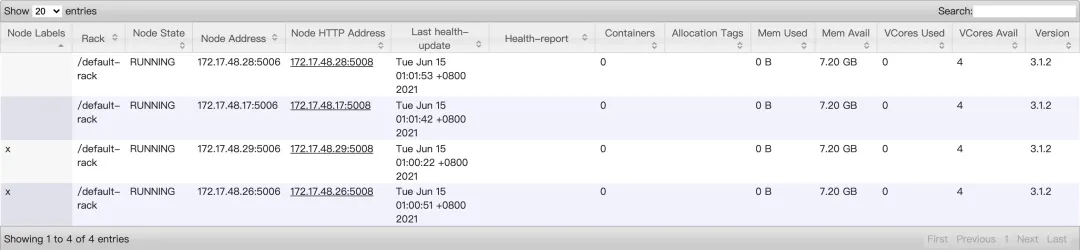

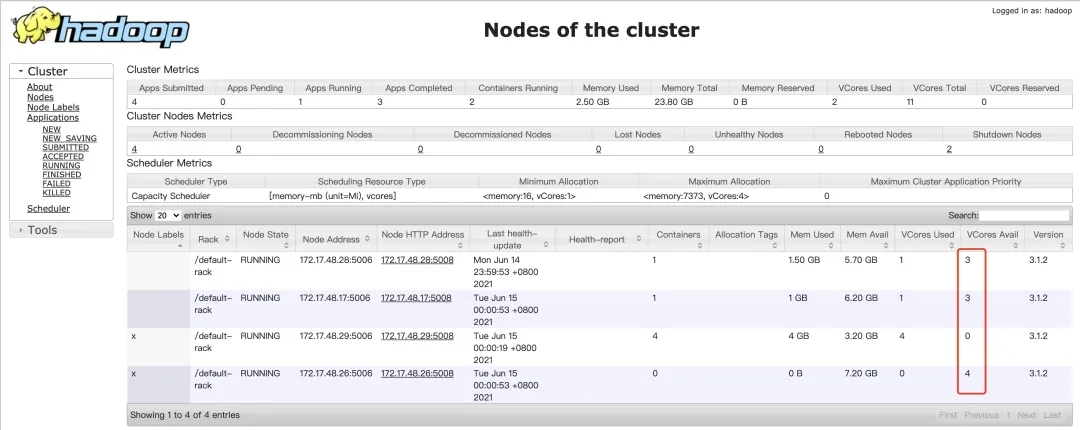

ТхІУ»Ћуј»тбЃ№╝џТїЄт«џ172.17.48.28/172.17.48.17уџёNodeManagerСИ║defaultтѕєтї║№╝ї172.17.48.29/172.17.48.26уџёNodeManagerСИ║xтѕєтї║сђѓ

<?xml version="1.0" encoding="UTF-8"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<property>

<name>yarn.scheduler.capacity.root.queues</name>

<value>a,b</value>

</property>

<property>

<name>yarn.scheduler.capacity.root.accessible-node-labels.x.capacity</nam e>

<value>100</value>

</property>

<property>

<name>yarn.scheduler.capacity.root.accessible-node-labels.y.capacity</nam e>

<value>100</value>

</property>

<!-- configuration of queue-a -->

<property>

<name>yarn.scheduler.capacity.root.a.accessible-node-labels</name>

<value>x</value>

</property>

<property>

<name>yarn.scheduler.capacity.root.a.capacity</name>

<value>50</value>

</property>

<property>

<name>yarn.scheduler.capacity.root.a.accessible-node-labels.x.capacity</n ame>

<value>100</value>

</property>

<!-- configuration of queue-b -->

<property>

<name>yarn.scheduler.capacity.root.b.accessible-node-labels</name>

<value>y</value>

</property>

<property>

<name>yarn.scheduler.capacity.root.b.capacity</name>

<value>50</value>

</property>

<property>

<name>yarn.scheduler.capacity.root.b.accessible-node-labels.y.capacity</n ame>

<value>100</value>

</property>

</configuration>

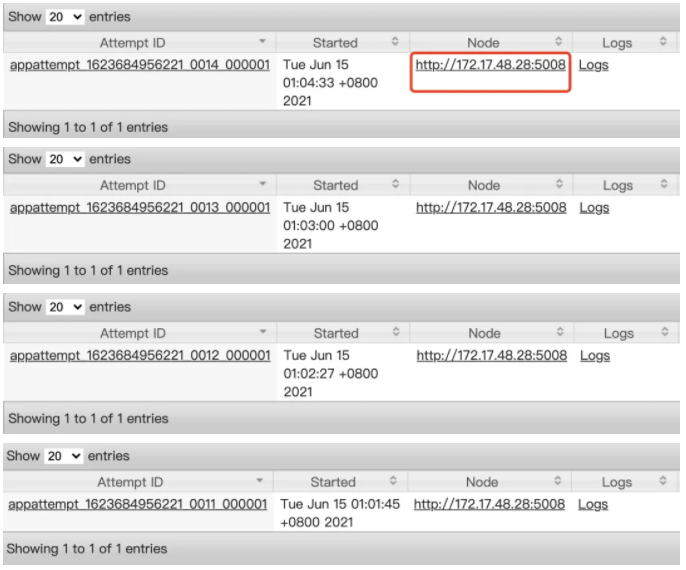

1.УДёт«џAMтЈфУЃйтѕєжЁЇтюе172.17.48.28

т»╣тЈдтцќСИЅСИфУіѓуѓ╣уџёNodeManagerУіѓуѓ╣жЁЇуй«тдѓСИІжЁЇуй«жА╣:

yarn.nodemanager.am-alloc-disabled=true

жЁЇуй«тљј№╝їТЈљС║цуџёApplicationуџёAMтЈфУЃйтюе172.17.48.28Уіѓуѓ╣тљ»тіесђѓ

2.Сй┐ућеу╗ётљѕТаЄуГЙ

жђџУ┐Єmapreduce.job.node-label-expressionТїЄт«џТаЄуГЙУАеУЙЙт╝Ј№╝їx||УАеуц║тљїТЌХСй┐ућеx/defaultтѕєтї║сђѓ

hadoop jar/usr/local/service/hadoop/share/hadoop/mapreduce/hadoop-mapredu ce-examples-3.1.2.jar pi-D mapreduce.job.queuename="a"-D mapreduce.job.node-label-expression="x||"10 10

Сй┐ућеУ»ЦтЉйС╗цТЈљС║цтљј№╝їУДѓт»Ътѕ░ApplicationуџёcontainerУбФтѕєжЁЇтюеx/defaultтѕєтї║сђѓ

тЏЏсђЂHadoop Yarn on Kubernetes PodТюђСй│т«ъУих

У»Цт«бТѕитцДТЋ░ТЇ«т║ћућетњїтГўтѓеУиЉтюеYarnу«АуљєуџётцДТЋ░ТЇ«жЏєуЙц№╝їтюеућЪС║Дуј»тбЃСИГ№╝їжЮбСИ┤У»ИтцџжЌ«жбў№╝їСИ╗УдЂСйЊуј░тюетцДТЋ░ТЇ«уџёу«ЌтіЏСИЇУХ│тњїтюеу║┐СИџтіАТ│бУ░иТЌХУхёТ║љуџёТхфУ┤╣сђѓтдѓуд╗у║┐У«Ау«Ќтюеу«ЌтіЏСИЇУХ│ТЌХ№╝їТЋ░ТЇ«тЄєТЌХТђДТЌаТ│ЋтЙЌтѕ░С┐ЮУ»Ђ№╝їт░цтЁХТў»тйЊжЂЄтѕ░жџЈТю║у┤ДТђЦтцДТЋ░ТЇ«ТЪЦУ»бС╗╗тіА№╝їТ▓АТюЅтЈ»ућеуџёУ«Ау«ЌУхёТ║љ№╝їтЈфУЃйтЂюТјЅти▓ТюЅуџёУ«Ау«ЌС╗╗тіА№╝їТѕќУђЁуГЅти▓ТюЅС╗╗тіАт«їТѕљ№╝ї?У«║тЊфуДЇ?т╝Ј№╝їТђ╗СйЊС╗╗тіАТЅДУАїуџёТЋѕујЄжЃйС╝џтцДТЅЊТіўТЅБсђѓ

тЪ║С║јHadoop Yarn on Kubernetes PodТќ╣ТАѕ№╝їт░єуд╗у║┐С╗╗тіАУЄфтіеТЅЕт«╣УЄ│С║ЉСИіжЏєуЙц№╝їСИјTKEтюеу║┐СИџтіАжЏєуЙцТиитљѕжЃеуй▓№╝їтЁЁтѕєтѕЕућеС║ЉСИіТ│бУ░иТЌХТ«хуџёжЌ▓уй«УхёТ║љ№╝їТЈљжФўуд╗у║┐СИџтіАуџёу«ЌтіЏ№╝їт╣ХтѕЕућеС║ЉСИіУхёТ║љт┐ФжђЪуџёт╝╣ТђДТЅЕт«╣УЃйтіЏ№╝їтЈіТЌХУАЦтЁЁуд╗у║┐У«Ау«Ќуџёу«ЌтіЏсђѓ

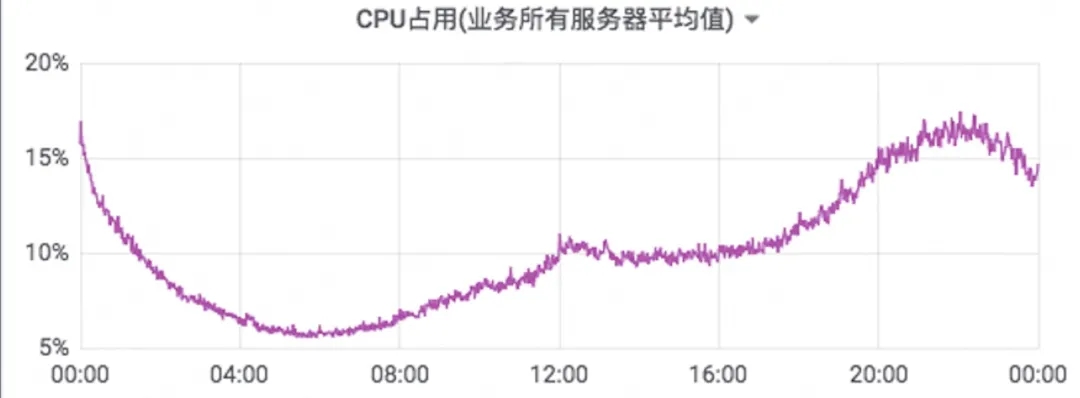

жђџУ┐ЄHadoop Yarn on Kubernetes Pod?ТАѕт»╣т«бТѕиуџётюеу║┐TKEжЏєуЙцУхёТ║љСй┐ућеУ┐ЏСИІС╝ўтїќтљј№╝їжЏєуЙцжЌ▓ТЌХCPUСй┐ућеујЄУЃйТЈљжФў500%сђѓ

тюеу║┐жЏєуЙцжЌ▓ТЌХCPUтЇауће

уд╗тюеу║┐ТиижЃетљјCPUтЇауће

С║ћсђЂТђ╗у╗Њ

ТюгТќЄТЈљтЄ║С║єтЪ║С║јYARNжњѕт»╣С║ЉтјЪућЪт«╣тЎетїќуџёС╝ўтїќСИјт«ъУих№╝їтюеТиитљѕжЃеуй▓С║ЉтјЪућЪуј»тбЃСИГ№╝їТъЂтцДтю░ТЈљжФўС║єС╗╗тіАУ┐љУАїуџёуе│т«џТђД№╝їжФўТЋѕТђД№╝їТюЅТЋѕТЈљжФўС║єжЏєуЙцУхёТ║љтѕЕућеујЄ№╝їУіѓу║дуАгС╗ХТѕљТюгсђѓтюеТюфТЮЦ№╝їТѕЉС╗гС╝џТјбУ«еТЏ┤тцџтцДТЋ░ТЇ«С║ЉтјЪућЪтю║ТЎ»№╝їСИ║С╝ЂСИџт«бТѕитИдТЮЦТЏ┤тцџуџёт«ъжЎЁТЋѕуЏісђѓ

- тдѓСйЋтюеiPhoneСИіт┐ФжђЪТЅЙтѕ░TikTokтЦйтЈІ№╝ЪУ┐ЎСИцСИфу«ђтЇЋТќ╣Т│ЋУй╗ТЮЙТљът«џ№╝Ђ

- тЏйтєЁућеТѕитдѓСйЋСИІУййтњїСй┐ућеTikTok№╝ЪУІ╣Тъютњїт«ЅтЇЊУ«ЙтцЄТюЅСИЇтљїУдЂТ▒ѓтљЌ№╝Ъ

- СИ╗У┤дтЈиСИјтЅ»У┤дтЈитдѓСйЋжЁЇтљѕуЏ┤ТњГ№╝ЪТЈГуДўтцДтЈиу▓ЅСИЮтбъжЋ┐уџёуДўУ»ђ№╝Ђ

- TikTokУй»Уи»ућ▒уюЪуџёТюЅт┐ЁУдЂтљЌ№╝ЪтдѓСйЋУ«ЕСйауџёуйЉжђЪТ»ћтѕФС║║т┐Ф№╝Ъ

- тЏйтєЁТЌаТ│ЋТГБтИИСй┐ућеTikTok№╝ЪУ┐ЎС║ЏУ«Йуй«СйауЪЦжЂЊС║єтљЌ№╝Ъ

- TikTokтИдУ┤ДТЮЃжЎљтдѓСйЋућ│У»и№╝ЪтЋєтЊЂТЕ▒уфЌУй╗ТЮЙтЈўуј░№╝їСйатГдС╝џС║єтљЌ№╝Ъ

- СИ║С╗ђС╣ѕтЏйтєЁтй▒УДєтЅфУЙЉСИЇУхџжњ▒С║є№╝ЪTikTokУЃйтљдТѕљСИ║СйауџёСИІСИђСИфУхџжњ▒тѕЕтЎе№╝Ъ

- TikTokуЪГУДєжбЉтИдУ┤ДТђјТаиТЅЇУЃйТюѕУхџ20СИЄ№╝Ът░ЈтЏбжўЪтдѓСйЋт┐ФжђЪт«ъуј░жФўТћХуЏі№╝Ъ